Stable Diffusionは、絵を描くスキルがなくても直感的に高品質な画像を生成できる画像生成AIです。

この記事では、Stable Diffusionの基本的な使い方から具体的なプロンプト事例までを初心者向けに紹介します。

Stable Diffusionで役立つプロンプト

ここからは、Stable Diffusionで役立つプロンプトを用途別で紹介します。

プロンプトとは、AIに指示を出すテキストのことです。

Stable Diffusionでは、プロンプトを通じて画像の内容やスタイルを指定できます。その簡単さと効果の高さから、一部では「呪文」とも呼ばれています。

また、プロンプトが具体的であればあるほどAIは理解して、より詳細な画像を生成できます。

Stable Diffusionの服装プロンプト

Stable Diffusionには、服装に関するプロンプトが多彩にあります。

あらかじめ生成される画像結果のサンプルがあればイメージを掴みやすいでしょう。

以下の記事で具体的な事例を画像付きでまとめていますので、こちらのページをご覧ください。

Stable Diffusionのポーズプロンプト

Stable Diffusionでは、プロンプトを工夫することで多様なアングルやポーズを指定できます。

その中でもキュンとするポーズを生成する場合に役立つプロンプトをこちらの記事でまとめましたので、ご覧ください。

Stable Diffusionの表情プロンプト

背景やポーズと組み合わせて表情を工夫することで、キャラクターの魅力が格段に引き立ちます。

以下の記事では表情差分を生成する方法や具体的な表情プロンプトをまとめて紹介しています。

Stable Diffusionの髪色プロンプト

Stable Diffusionを用いてキャラクターのイラストを生成する際、その印象を大きく左右するのが髪の色です。

単純な色の指定だけでなく、アニメやファンタジー作品に見られるような複雑な色彩表現も、プロンプト次第で自在に作り出すことが可能です。

以下の記事では、カタログ形式で髪色パターンを細かく紹介しています。

Stable Diffusionの男性・女性髪型プロンプト

Stable Diffusionには、人物を固定した上で髪型だけ変えて画像を生成する方法があります。

髪型に限って差分を生成することによって、キャラクターの特徴を掴む効率が上がります。

以下の記事では、実例をもとに詳しいステップを画像付きで紹介しています。

Stable Diffusionの男性髪型プロンプト

Stable Diffusionで男性の髪型を表現するプロンプトは、理想の髪型を自由に生成できないことがあります。

イメージとプロンプトワードが関連せずに分かりづらくなっていることがその理由です。

以下の記事では、男性の髪型に関するプロンプトを画像付きでまとめていますので、ご覧ください。

Stable Diffusionでリアル・実写系 女性の髪型プロンプト

Stable Diffusion で女性の髪型を表現するプロンプトは無数に存在します。

その中で、代表的な髪型のプロンプトと髪型に特化したLoRAを以下の記事では画像付きでまとめています。

Stable Diffusion男性プロンプト(呪文)集

Stable Diffusionで男性を生成しようとしても、思ったより女性的になってしまうことはよくあります。

男性キャラクターをしっかり再現するための基本プロンプトや必要なポイントをまとめて解説します。

Stable Diffusionプロンプトのコツ

プロンプト作成には一定のルールやコツがあります。入力の工夫次第で、想像以上に高品質な画像を生成することが可能です。

以下の記事では、プロンプトの仕組みや入力のコツについて解説しています。

Stable Diffusionのネガティブプロンプト利用法とその効果

Stable Diffusionには、画像を生成する際に除外したい内容を入力する「ネガティブプロンプト」があります。

ネガティブプロンプトを使いこなすことができれば、飛躍的に画像の精度が上がります。

以下の記事では、ネガティブプロンプト利用法とその効果をまとめました。

Stable Diffusionの呪文(プロンプト)で美少女を描くための完全ガイド

Stable Diffusionの呪文(プロンプト)にはルールがあります。呪文のコツを掴めれば、画像生成が一段と楽しくなるでしょう。

特に美少女イラストの生成を目指す場合、プロンプト作成のポイントを押さえることが重要です。詳細は以下の記事で解説しています。

Stable Diffusionの使い方は、機能別に下記の記事にまとめているのでぜひご覧ください

Stable Diffusionの使い方

Stable Diffusionにはさまざまな機能が備わっていますが、公式から説明書のようなドキュメントは出ていません。

ここからは、Stable Diffusionの使い方を機能別に紹介していきます。

img2imgの使い方!画像から画像を生成する方法を解説

Stable Diffusionのimg2imgは、既存の素材画像を元に新たな画像を生成する機能です。

以下の記事でimg2imgの機能と使い方をまとめました。

inpaintの使い方!画像を部分修正・不要部分を消す方法

Stable Diffusionのinpaintとは、画像を変更・修正する機能です。

inpaintを使いこなせば、生成に失敗した部分だけを再生成することができるので、再試行の手間などが省けます。

以下の記事では、inpaintの仕組みから応用した使い方までをまとめています。

Inpaint Sketchの使い方!img2imgで画像を自然に修正する手順

Stable DiffusionのInpaint Sketchは、画像の一部を修正・変更できるinpaint sketchという便利なツールがあります。

修正したい範囲を塗りつぶすマスク機能に加え、そのマスク部分に直接色を塗ったり簡単なスケッチを描き込んだりすることができます。

プロンプトだけでは伝えきれない細かなニュアンスも画像に反映させることが可能になります。

以下の記事では、Inpaint Sketchの仕組みから応用した使い方までをまとめています。

Seed値(シード値)とは?意味やおすすめの使い方を解説

Stable Diffusionでは、Seed値を活用することで、同じキャラクターの表情変化や同じ背景の時間帯変化などを連続して生成することができます。

以下の記事でSeed値の仕組みから使い方まで詳しく解説しています。

Clip skipの使い方!にじみ・崩れを減らす実践テクニック

Clip skipは、プロンプトをどれだけ深く解釈するかを調整し、イラスト全体の完成度を高めることができます。

以下の記事でClip skipの具体的な作例を交えた実践テクニックを紹介しています。

スケジュールタイプと構文の基本解説

同じプロンプトでも生成される画像の質が違うのは、サンプラーとスケジュールタイプという大事な設定が関わっているのが影響しています。

以下の記事で、すべてのスケジューラーを使った作例を交えて実践したテクニックを紹介しています。

CFG Scaleのおすすめ値は?比較画像付きで解説

CFG Scaleは、プロンプトへの忠実度をコントロールする重要なパラメータです。

以下の記事で、CFG Scaleの仕組みから、実際の作例を交えながら最適値の見つけ方を解説しています。

Sampling methodの違いを解説

Stable Diffusionは、どのサンプラーを選択するかによって、同じプロンプトやシード値であっても、生成される画像の品質、細部の描写、雰囲気、そして生成にかかる時間が大きく変化します。

以下の記事で、Sampling methodの仕組みとそれぞれの違いを徹底的に解説しています。

BREAK構文・強調構文の使い方

Stable Diffusionでは、強く表現したいプロンプトに対して強調構文を利用する方法があります。

強調構文を使えば、生成画像にメリハリが生まれて高度なビジュアルを実現できます。

以下の記事でBREAK構文・強調構文の具体的な使い方を解説しています。

プロンプト(呪文)のテンプレートと保存する方法

Stable Diffusionにおけるテンプレートとは、txt2img機能を使う際に、プロンプト(呪文)やパラメータ、各種設定をあらかじめ定型化した雛形のことです。

毎回一から設定する必要がなく、簡単に目的に合った画像生成が行えます。

以下の記事で、すぐに使える便利なプロンプトテンプレートや、保存・管理する方法を解説していまます。

高画質化するには?おすすめの方法を解説

Stable Diffusionでは、構成内容を再描画することで、画像の質を保ったまま高画質化する方法があります。

以下の記事では、Stable Diffusionを使って、画像を高画質化する様々な方法をケース別に解説しています。

Stable Diffusionのモデル

Stable Diffusionのモデルとは、テキストプロンプトから高品質な画像を生成するために大規模なデータを用いてトレーニングされた生成AIモデルデータを指します。

モデルを切り替えることによって、多様なスタイルや画風を自由に選択することができます。

モデルの特徴を理解することで、画風や細かいタッチに至るまでをコントロールすることができるでしょう。

Stable Diffusionモデルとは? 一覧とその特徴を紹介

Stable Diffusionモデルは、与えられたテキストプロンプトに基づいて画像を生成するタスクで使用される学習済みのデータです。

以下の記事では、これらモデルの仕組みや入手方法、使い方などを詳しく解説しています。

checkpoint(ckpt)とは?アニメ系おすすめモデルや導入方法

Stable Diffusionのcheckpoint(ckpt)とは、モデルの学習過程における特定の状態を保存したファイルで、学習データを追加して他の学習データとマージすることも可能です。

Checkpointに関する詳しい情報はこちらのページをご覧ください。

Stable Diffusionの最新おすすめモデル10選!使い方もご紹介

Stable Diffusionには、アニメ風のイラストからリアルな実写風画像まで、無数のモデルが存在します。

以下の記事では、その中でも最新のおすすめモデル10選の使い方を紹介しています。

Stable DiffusionのControlNet

ControlNetは、細かな条件を指定して画像生成できるStable Diffusionの拡張機能です。

プロンプトだけでは指定できない要素を生成画像に含めることができます。

ControlNetとは?

ControlNetは、画像生成AI「Stable Diffusion」を拡張するための強力なツールです。

ControlNetを利用することによって画像から線画を抽出したり、ポーズを抽出したりすることができます。

詳しいインストール方法と機能に関してはこちらの記事で解説しています。

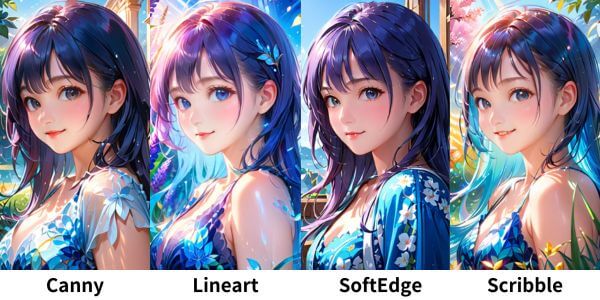

ControlNet Cannyの使い方!線画抽出から着色まで

ControlNetのCannyは、線画を抽出して自由に着色や加工ができる機能です。

Stable Diffusionのプロンプトでは調整が難しいと言われる、特定のカラースタイルやテーマに合わせた画像を簡単に作成することができます。

以下の記事では、Cannyの導入方法から使い方まで詳しく解説しています。

ControlNet Depthの使い方!設定方法から作り方など

ControlNetのDepthは、線画などでは表現できない、奥行きがある構図を加工ができる機能です。

立体感を自在に操ることができる設定方法から具体的な作り方まで、初心者でもわかる完全ガイドをお届けします。

以下の記事では、Depthの導入方法から使い方まで詳しく解説しています。

ControlNet OpenPoseの使い方!棒人間からポーズ指定

ControlNet OpenPoseは、人物の関節や骨格を検出して、そのポーズを元にした画像を生成することができる機能です。

OpenPoseを使えば、モデルに対して具体的な身体の配置や動作を指示することができるため、意図した通りのポーズを反映した画像が生成できます。

以下の記事でOpenPoseの導入方法から使い方まで詳しく解説しています。

ControlNetのLineartの使い方!基本や応用テクニック

ControlNetのLineartは、特定の構図やアウトラインを維持しながら、より詳細な画像を生成する機能です。

線画をベースにLineartがクリエイティブなアイデアをビジュアル化して補助してくれることでしょう。

以下の記事では、Lineartの導入方法から使い方まで詳しく解説しています。

ControlNet Scribbleで線画抽出やイラストを作成する方法

ControlNet のScribbleは、シンプルな線や形のラフ画から、意図に沿った美しいビジュアルの画像を生成できる機能です。

Scribbleには柔軟性があり、調整しながら異なるスタイルやテーマでイメージの出力を試すことができます。

以下の記事でScribbleの導入方法から使い方まで詳しく解説しています。

ControlNet SoftEdgeとは?ダウンロード方法や使い方

ControlNet SoftEdgeは、重要な輪郭(エッジ)を維持して画像を生成する機能です。

独特なタッチなどの重要なディテールを保持しつつも、全体の調和を損なわずに画像を生成できるため、クオリティの高い画像に仕上がります。

以下の記事でSoftEdgeの導入方法から使い方まで詳しく解説しています。

ControlNet Shuffleの使用法を解説!何ができる?

ControlNet Shuffleは、入力された画像を分解し、その色合いやスタイルを活用して新たな画像を生成するStable Diffusionの拡張機能です。

元の画像が持つスタイルや色を継承しながら、簡単に新しいバリエーションを作成できます。

以下の記事でShuffleの導入方法から使い方まで詳しく解説しています。

ControlNet NormalMapとは?使い方やよくあるエラーを解説

ControlNet NormalMapは、2次元の素材画像から立体構造情報を抽出して新たに画像を生成する拡張機能です。

プロンプトを使用して細かい凹凸や質感を再現するのが難しいので、この法線マップ機能を使います。

以下の記事でNormalMapの導入方法から使い方まで詳しく解説しています。

ControlNetのRevisionとは?特徴や使い方を解説

ControlNet Revisionは、既存モデルの多様性を引き出してアイデアを創出してくれる拡張機能です。

特定の構図や要素を保持しつつ、デザインやテーマを変更や細かな調整が可能です。

以下の記事でShuffleの導入方法から使い方まで詳しく解説しています。

ControlNet IP-Adapterで画像生成をコントロールしよう!

ControlNetのIP-Adapterは、画像を基にすることで、実現が難しかった細かいスタイルの調整や、類似の画像が生成可能になります。

IP-Adapterを利用すれば、一貫性のあるビジュアル制作が容易になり、創作の幅を広げることができます。

詳しくは以下の記事をご覧ください。

ControlNetのInstantIDをStable Diffusionで活用する方法!

ControlNetのInstantIDは、人物画像をもとに、異なるポーズ・服装・背景でも同一人物を保った画像を自動生成できる機能です。

InstantIDを利用すれば、顔立ちやパーツ配置などの特徴を保ちつつ、服装や背景、アートスタイルを変えた画像を生成することができます。

詳しくは以下の記事をご覧ください。

ControlNet Referenceの使い方!エラーが出てしまったときの解決策も

ControlNetのReferenceは、特定の参照画像を基にして新しい画像を生成する機能です。

Referenceを利用すれば、お気に入りのキャラクターにさまざまなアレンジを加えることができます。

詳しくは以下の記事をご覧ください。

ControlNet MLSDの使い方!プロンプト作成や設定を解説

Stable Diffusionで製図を作成するのにも活用できます。

ControlNet MLSDは、建築・インテリア・プロダクトデザインなど、直線やパース精度が求められる画像生成に最適です。

こちら記事では、ControlNetのMLSDを使う方法を詳しく解説します。

ControlNet Segmentationの使い方!基本から応用まで

ControlNetのSegmentationは、「服だけ着せ替えたい」「背景だけ差し替えたい」といったワガママを簡単に叶えてくれる機能です。

色分けしたパズルを組み替えるように、部分ごとに違う効果やスタイルを適用できます。

こちらの記事ではControlNet Segmentationの使い方を詳しく解説します。

Stable DiffusionのLoRA/VAE/embeddings

Stable DiffusionのLoRA/VAE/embeddingsは、画像生成に独自のコンセプトを加えることができる追加学習データです。

checkpoint(ckpt)に加えることで、追加の学習データをアレンジした画像を生成することができます。

LoRAの使い方!おすすめもご紹介します

LoRAは、モデルをカスタマイズして効率的に微調整を加える生成機能で、Stable Diffusionモデルを特定のニーズに合わせてカスタマイズする際に非常に有用です。

以下の記事でLoRAの導入方法から使い方まで詳しく解説しています。

VAEとは?使い方や拡張機能について解説!

Stable DiffusionでVAEを活用することで、生成される画像のリアリズムと多様性を高めることができます。

画像のノイズを効果的に除去しつつ、重要な特徴を保持することができ、生成される画像の品質が向上します。

以下の記事でVAEの導入方法から使い方まで詳しく解説しています。

EasyNegativeの導入方法と使い方!

EasyNegativeとは、Stable Diffusionで画像を生成する際、望ましくない特徴や要素を避けるために使用されるネガティブプロンプトをひとまとめにした埋め込みファイルです。

以下の記事で、EasyNegative に代表されるembeddingsの仕組みとおすすめの埋め込みファイルを紹介しています。

Stable Diffusionローカル版の設定

Stable Diffusionは、ローカルのパソコンにダウンロードしてオフラインで利用することが可能です。

ローカル版では一部の機能が制限されてしまうことがありますが、無料で利用できるなどのメリットがあります。

Stable Diffusionローカル版のダウンロード方法から使い方までまとめた記事をご紹介します。

Stable Diffusionローカル版のダウンロード方法を解説

以下の記事では、Stable Diffusionを自分のPCにダウンロードして使う方法とあわせて推奨スペックや必要となるソフトも紹介しています。

Stable Diffusion初心者にはWeb UIがおすすめ!

以下の記事では、Stable Diffusion Web UIの仕組みとインストールから画像生成までの使い方を画像付きで完全解説しています。

Stable DiffusionのWebUIを日本語化するための簡単ステップ

Stable Diffusionは英語が標準仕様のフリーソフトウェアです。そのため、英語が苦手な方にとっては導入の段階から難しく感じてしまうでしょう。

以下の記事では、英語が苦手な方向けに、Stable DiffusionのWebUIを日本語化する手順を解説しています。

Stable DiffusionをGitで導入・管理する方法

Gitによるバージョン管理を活用することで、環境の再現性を高め、複数のマシンでの同期や、実験的な変更の管理が容易になります。

以下の記事では、Gitを使ってStable DiffusionのWebUIを管理する方法を解説しています。

Stable Diffusion FLUX.1

FLUX.1は、2024年8月に公開されたStable Diffusion画像生成AIモデルの最新バージョンです。

このあと紹介するそれぞれの記事で、導入方法からおすすめのモデルまでを画像付きで詳しく紹介しています。

FLUX.1ローカル環境の使い方

「FLUX.1」は、ローカル環境での利用が可能ですが、使用方法は限定されています。

こちらの記事で、WebUI ForgeとComifyUI環境での導入方法から使い方をまとめています。

FLUX.1のおすすめモデル6選

以下の記事では、Stable Diffusion FLUX.1の性能を最大限に活用できるおすすめモデルを、アニメ風と実写風に分けて紹介しています。

Stable Diffusion 3.5

Stable Diffusion 3.5は、Stability AIが公開したStable Diffusionの最新の公式ベースモデルです。

FLUX.1と同等のパフォーマンスを発揮しながら、効率的なパフォーマンスと高いカスタマイズ性を兼ね備えているのが特徴です。

Stable Diffusion 3.5ローカル環境の使い方

Stable Diffusion 3.5は、ComifyUIでのローカル利用が便利です。

この記事では、Stable Diffusion 3.5のComifyUI環境での導入方法から使い方をまとめています。

Stable Diffusion 3.5ControlNetの使い方

Stable Diffusion 3.5 ControlNetは、ControlNetの最新バージョンです。

現在利用できる機能は「Blur」「Canny」「Depth」の3種類です。

次の記事では、ComfyUIで利用するワークフローの使い方を解説しています。

その他Stable Diffusionについて

Stable Diffusionを快適に利用するには、ブラウザで画像生成できるピクソロがおすすめです。

ピクソロは、ローカル版のStable Diffusionと同じ使い方でオンライン利用できるサービスです。

複雑なセットアップが不要で、登録すればすぐに利用できます。

ストレスのない生成スピードと、ノートパソコンのブラウザ経由でいつでもどこでも利用が可能です。

「PICSOROBAN(ピクソロ)」の使い方【初級編】

【初級編】PICSOROBANの登録方法から使い方まで完全解説!

「PICSOROBAN(ピクソロ)」の使い方【中級編】

【中級編】PICSOROBANの使い方は、追加学習モデルデータとControlNetの使い方をメインに詳しく解説!

「PICSOROBAN(ピクソロ)」の使い方【上級編】

【上級編】PICSOROBANの使い方は、プロンプト、パラメータ、拡張機能などあらゆる要素を掌握し、Stable Diffusionを完全に使いこなす方法を解説したマスター向けの内容になっています。

Stable Diffusionで画像生成を楽しもう!

この記事では、Stable Diffusionのプロンプトの活用方法や機能別の使い方、最新モデルや拡張機能について解説しました。

Stable Diffusionの使い方のコツを掴むことで、より自由で創造的な画像生成を実現できます。

詳しい手順や実例については、リンク先の記事を参考にして、ぜひStable Diffusionの可能性を体験してください!

ブラウザで簡単!ピクソロ!

PICSOROBANは、インストールの必要なくブラウザで簡単にStable Diffusionを利用できます。

さらに、今ならリリースキャンペーンとして無料会員登録するだけで、2,000ポイント(約2時間分)貰えます!

詳しい使い方は下記の記事で紹介しています。

\今なら約2時間無料で使える!/