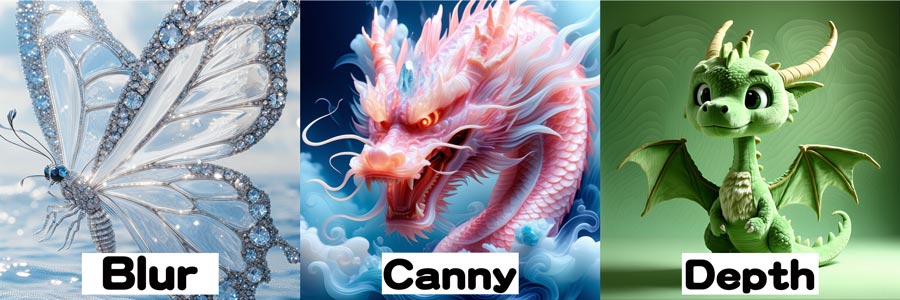

Stability AIは11月26日、「Stable Diffusion 3.5 Large」上で使用できるControlNetの機能3種「Blur」「Canny」「Depth」を発表しました。

「Stable Diffusion 3.5 ControlNet」は、Stable Diffusionの主要機能であるControlNetの最新バージョンになります。

この記事では、「Stable Diffusion 3.5 ControlNet」の使い方を初心者向けに詳しく解説します。

Stable Diffusion 3.5 ControlNetとは?

Stable Diffusion 3.5 ControlNetは、インテリアデザインからキャラクター制作まで幅広い用途に最適できる拡張機能です。

今回発表された機能は「Blur」「Canny」「Depth」の3つです。

それぞれ特徴は下記にまとめました。

- 「Blur」8K ~ 16K の解像度を含む、高いアップスケーリングが可能!

- 「Canny」エッジマップを抽出して生成された画像を構造化します!

- 「Depth」深度マップを使用して、画像生成を構成を正確に制御します!

Blurの特徴

「Blur」は、低解像度の画像をアップスケール(拡大)する拡張機能です。

現在まで、完成した画像の質を保ったままスケールアップするのは困難でしたが、AIが構成内容を再描画することで高画質化が可能になりました。

「Blur」を使用すれば、8K ~ 16Kなどの画像サイズにも質を落とすことなく生成が可能です。

Cannyの特徴

「Canny」は、線画をそのままに色塗りを自由に変更できる拡張機能です。

イラストに対して特に便利で、その他にもあらゆるスタイルに適用ができます。

Depthの特徴

「Depth」は、参照画像の立体的な構図を抽出して生成することができる拡張機能です。

線画などでは表現ができない奥行きがある構図を指定したい場合は「Depth」がおすすめです。

Stable Diffusionの使い方は、機能別に下記の記事にまとめているのでぜひご覧ください

Stable Diffusion 3.5 ControlNetの使い方

ここでは、「ComfyUI」上でのStable Diffusion 3.5 ControlNetの使い方を紹介します。

Stable Diffusion 3.5 ControlNetは、多くのGPUパワーが必要になりますので、余裕をもって準備をしておきましょう。

導入前に「ComfyUI」を起動して最新版に更新しておきましょう。

まずは「ComfyUI」上でStable Diffusion 3.5を動かす準備をします。

既にStable Diffusion 3.5を動かすデータセットがある方は、次のステップに進みます。

導入までのステップは、こちらの記事で紹介しています。

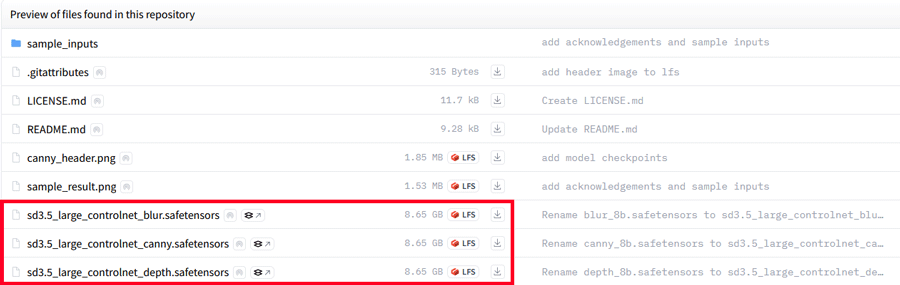

Stable Diffusion 3.5 ControlNet用に学習されたモデルをダウンロードします。

Hugging FaceからStability AIが公式に配布しているモデルデータを入手します。

「ComfyUI」>「models」>「controlnet」を開き、データを格納します。

合計で26Gほどあるので気長に待ちます。

データのセットが完了したらComfyUIを起動します。

ControlNetを使用する前にComfyUIを最新版に更新しておきます。

ComfyUIの公式ブログからStable Diffusion 3.5 ControlNet専用のワークフローを入手します。

それぞれ3枚のワークフローが埋め込まれている画像をダウンロードします。

ComfyUIの画面にドラッグ&ドロップで画像を読み込むと埋め込まれているワークフローデータを表示することができます。

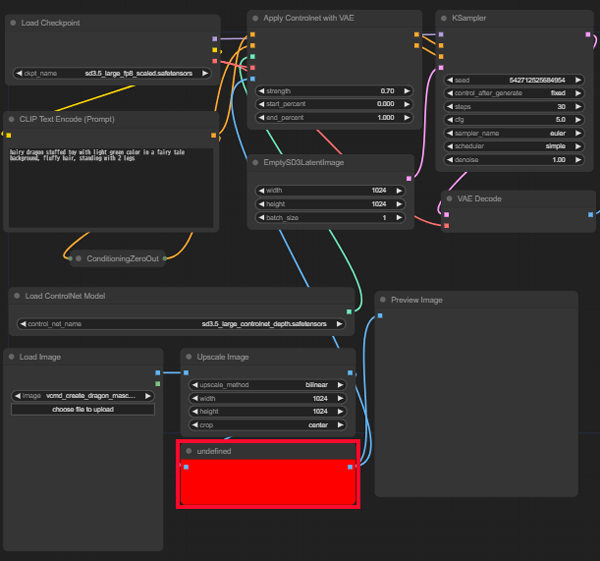

ワークフローを展開して、各ノードが正常に反映されているかを確認します。

赤くなっている未入手のカスタムノードがある場合は、手動で補填していきます。

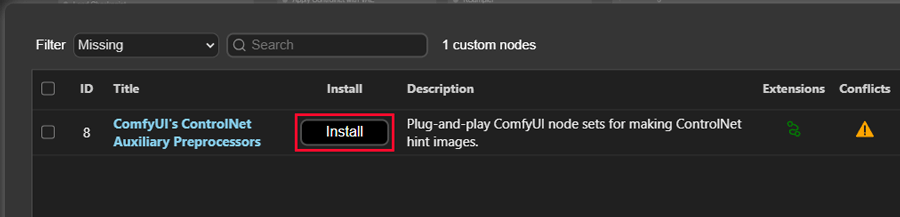

右のパネルの「Manager」ボタンをクリックして、中列の「Install Missing Custom Nodes」を選択します。

足りないカスタムノードが一覧で表示されるので、ノードをインストールします。

再起動して赤いノードがないことを確認して生成を開始します。

Checkpointには、「sd3.5_large_fp8_scaled.safetensors」を利用しますので用意がない場合は下記サイトからダウンロードしておきましょう。

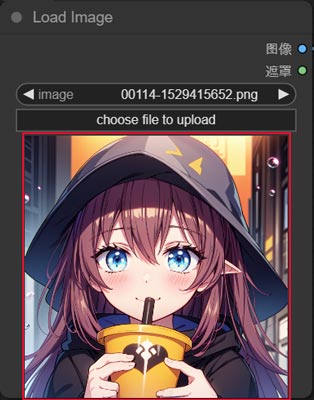

Blur

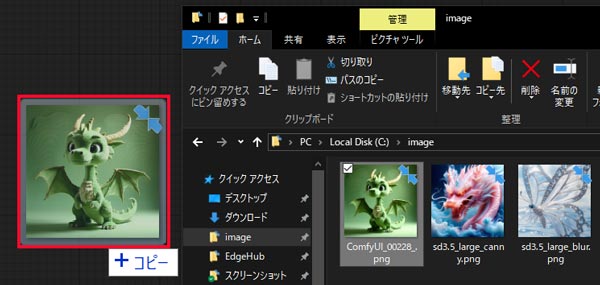

Blurは、画像の解像度を上げるアップスケールする機能です。

素材の画像を用意して生成したい解像度のサイズを入力します。

今回は素材画像(512×512)を2倍の(1024×1024)サイズにアップスケールして生成したいと思います。

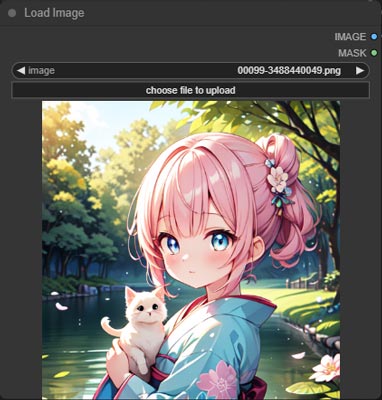

Load image

・アップスケールしたい素材の画像を読み込みます。

Prompt

・変更内容を含めたプロンプトを入力します。

今回は絵の内容に変更はないので、プロンプトは絵の内容だけを入力します。

各種のパラメータやプロンプト以外の入力項目やパラメータは、入力しなくても問題ありません。

生成は右上の「Queue Prompt」ボタンをクリックて生成を開始します。

初回の生成はモデルデータのダウンロードを伴うので時間がかかります。

A woman wearing Japanese clothes holding a cat

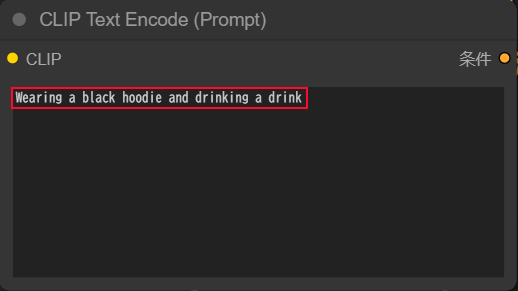

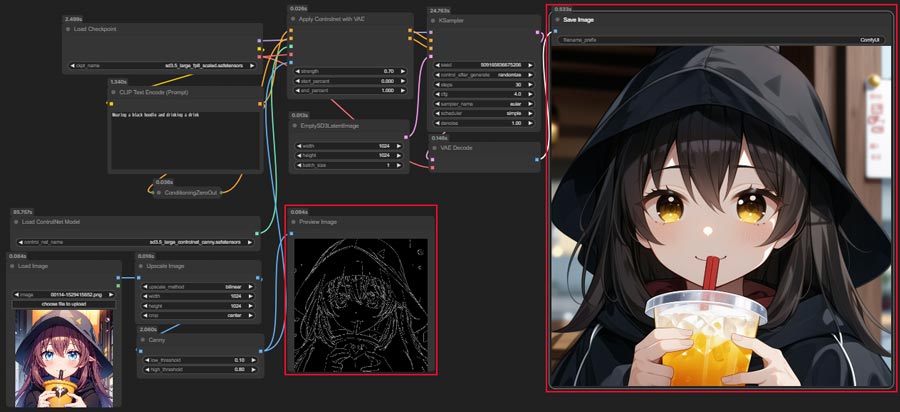

Canny

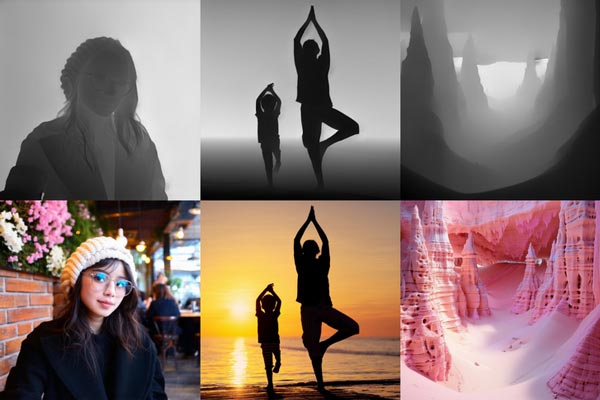

Cannyは、元の画像から輪郭線を抽出して新たに画像を生成する機能です。

デザイン線画を元に再度画像生成してくれるので、塗り方のパターンを増やすことができます。

今回は素材画像から線画を抽出して画風を変えて生成してみたいと思います。

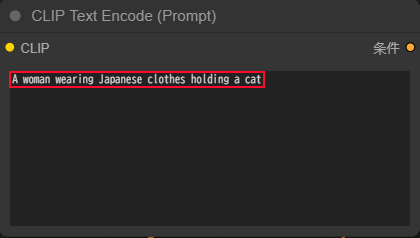

Load image

・線画を抽出したい素材の画像を読み込みます。

Prompt

・変更内容を含めたプロンプトを入力します。

今回は絵の内容に変更はないので、プロンプトは絵の内容だけを入力します。

各種のパラメータやプロンプト以外の入力項目やパラメータは、入力しなくても問題ありません。

生成は右上の「Queue Prompt」ボタンをクリックて生成を開始します。

線画の抽出から書き出しまで1アクションで完了します。

Wearing a black hoodie and drinking a drink

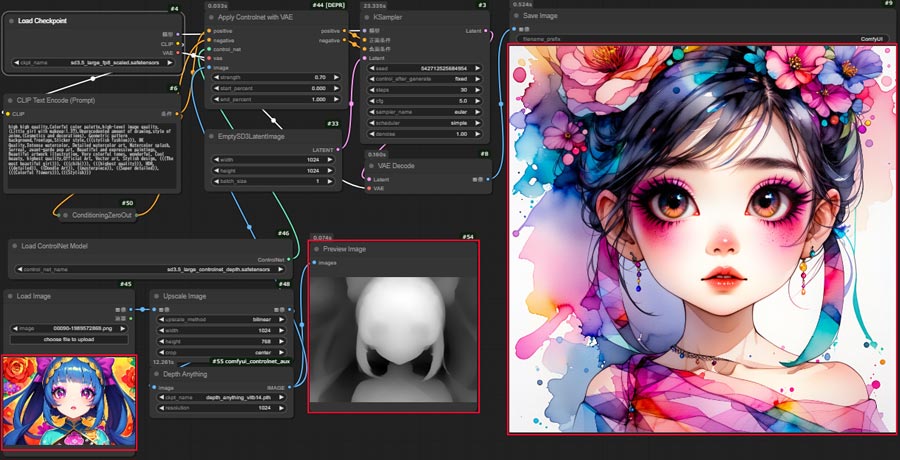

Depth

Depthは、奥行きがある構図の画像が最も素材として適しています。

深度がない平面が背景になっているような画像は、Depthでは反映ができずに内容が上書きされてしまうので注意しましょう。

今回は素材画像の立体感を維持しながら画風を水彩風に変えて生成してみたいと思います。

Load image

・線画を抽出したい素材の画像を読み込みます。

今回は横長の画像サイズの深度を抽出するので、生成さする画像の比率も横長に指定します。

Prompt

・変更内容を含めたプロンプトを入力します。

画像サイズ以外の入力項目やパラメータは、入力しなくても問題ありません。

生成は右上の「Queue Prompt」ボタンをクリックて生成を開始します。

線画の抽出から書き出しまで1アクションで完了します。

high quality,Colorful color palette,high-level image quality,(Little girl with makeup:1.37),Unprecedented amount of drawing,style of anime,(Cosmetics and decorations),Geometric pattern background,frontage,Sticker style,(((stylish fashion))), 8K Quality,Intense watercolor, Detailed watercolor art, Watercolor splash, Surreal, avant-garde pop art, Beautiful and expressive paintings, Beautiful artwork illustration, Very colorful tones, wonderful, Cool beauty, highest quality,Official Art, Vector art, Stylish design, (((The most beautiful girl))), (((chibi))), (((highest quality))), HDR, ((detailed)), ((Doodle Art)), ((masterpiece)), ((Super detailed)), (((Colorful flowers))),(((Stylish)))

スポンサーリンク

Stable Diffusion 3.5 ControlNetの商用利用は?

Stable Diffusion 3.5 ControlNetの料金プランと商用利用に関して紹介します。

Stable Diffusion 3.5 ControlNetの料金プラン

Stable Diffusion 3.5 ControlNetの公式プロジェクトは、商用および非商用の両方で無料で使用することができます。

非営利使用は無料で、個人および組織は非営利目的でモデルを無料で使用できます。

Stable Diffusion 3.5 ControlNetの商用利用は?

Stable Diffusion 3.5の商用利用には制限が設けられています。

Stability AIのコミュニティライセンスによると年間収入が100万ドル未満の個人や組織は研究用、非商用利用、商用利用が可能になります。

年間収入が100万ドルを超える場合は、Stability AIからエンタープライズライセンスの取得が必要になります。

コミュニティライセンスの概要は以下の通りです。

| 目的 | 料金 | 商用利用 | 備考 |

|---|---|---|---|

| 非営利目的 | 無料 | 可 | – |

| 商用利用 | 無料(年間収益100万ドルまで) | 可 | 100万ドル以上の企業は、エンタープライズライセンスの問い合わせが必要 |

Stable Diffusion 3.5 ControlNetを使いこなして生成AIをマスターしよう!

今回は、Stability AIが公開した最新の画像生成AIツール「Stable Diffusion 3.5 ControlNet」の使い方について紹介しました。

今回は3つの機能だけでしたが、引き続きStable Diffusion 3.5 の進化に期待ができそうです。

無料で利用できる動画生成AIの応用機能の中でトップクラスなので、このチャンスに高性能ツールで画像生成を極めてみましょう。