Stable Diffusionでは、checkpointを使って様々なモデルの画像を生成することができます。

checkpointの仕組みを理解して使いこなすことで、思い通りの画像を生成することができるようになります。

この記事では、Stable Diffusionのcheckpointの特徴と利用方法についてを解説しながら、おすすめモデルを紹介します。

Stable Diffusionのcheckpointとは

Stable Diffusionのcheckpointとは、生成された画像の特徴を学習した内容を保存したデータを指します。

checkpointは、ファイル名「ckpt」と略され、ダウンロードサイトで公開されています。

Stable Diffusionのcheckpointとモデルの違い

Stable Diffusionにおいて「checkpoint」と「モデル」は厳密には異なるものです。

- Checkpointとは、トレーニング中の学習している最中の一時的なデータを指します。

- モデルとは、データから決定を行って画像を生成するプロセスそのものを指します。

専門的な仕組みなので、Stable Diffusionを利用する上では特に気にしなくて問題ありません。

Stable Diffusionでアニメ系おすすめのcheckpoint(モデル)

Stable Diffusionでアニメ系おすすめのcheckpointをいくつか紹介します。

Counterfeit-V3.0

「Counterfeit-V3.0」は、アニメ系美少女モデルを生成できるモデルです。

服装からアイテムまで細かい設定に対応できるようになっています。

また、人物だけでなく、風景や景色の生成においても高く評価されています。

blue_pencil-XL

「blue_pencil-XL」は、SDXL 1.0ベースにしたアニメ・イラストに特化したマージモデルです。

非常に多くのモデル数を学習し、バージョンアップを繰り返しています。

アニメイラスト以外にもリアルに近い2.5次元の画像も生成可能です。

Reproduction

「Reproduction」は、リアル寄りからアニメ寄りまで幅広い画風の生成が可能なモデルです。

全体的に淡く柔らかいタッチが特徴です。

Stable Diffusionのcheckpoint導入方法

Stable Diffusionのcheckpoint導入方法は、モデルファイルを提供しているサイトからダウンロードして、ローカルフォルダに保存します。

Hugging FaceとCivitaiのサイトで提供者の説明を読んで好みのcheckpointをダウンロードしましょう。

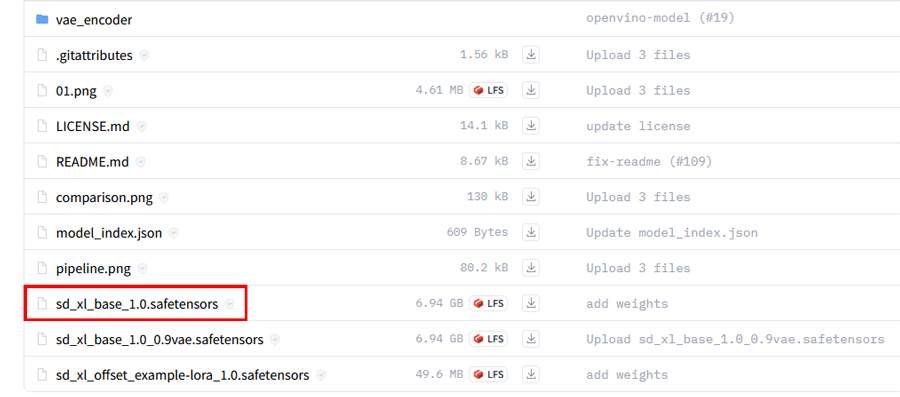

ダウンロードしたいcheckpointの「Files and versions」タブに移動後、ページ下部の「○○.safetensors」を「download」ボタンをクリックしてダウンロードします。

ダウンロードしたモデルデータの拡張子は、「.safetensors」もしくは「.ckpt」で表示されています。

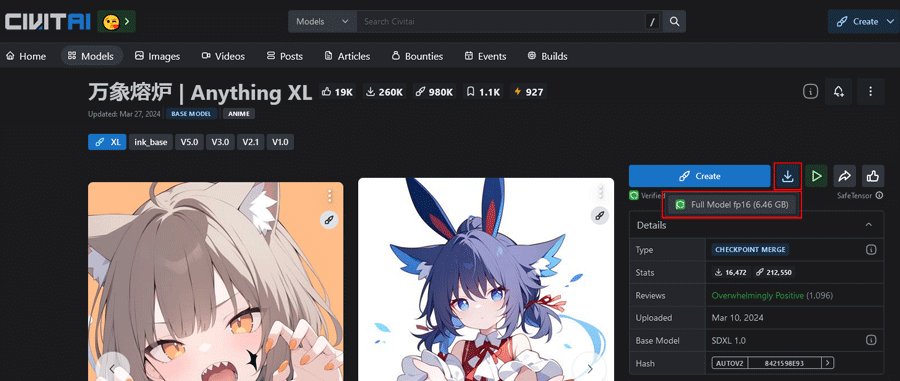

サイトにユーザー登録してから、ダウンロードしたいcheckpointの「.safetensors」ファイルをダウンロードします。

詳しいcheckpoint導入方法は下記の記事でも紹介しています。

Stable Diffusionモデルの使い方

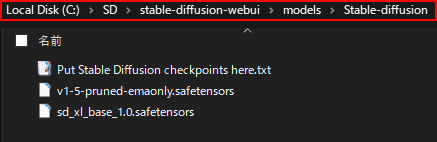

ダウンロードした「○○.safetensors」を、Stable Diffusion「models」>「Stable-diffusion」の順で開き、「Stable-diffusion」の中にファイルを配置します。

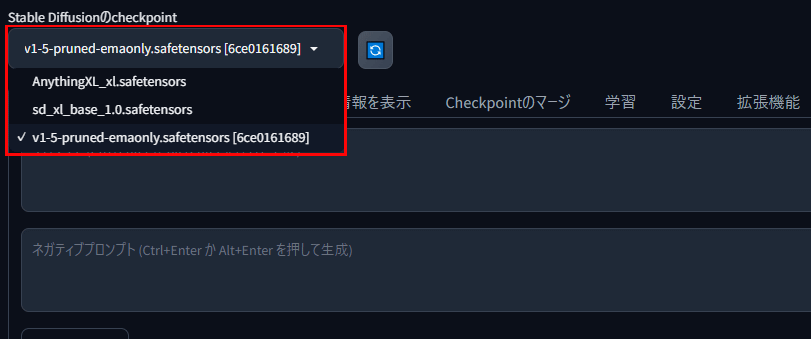

その後、Stable Diffusion Web UIを開き、画面左上の「checkpoint」と書かれている部分の下にある「▼」から選択し、モデルを切り替えることで適用します。

Stable Diffusionのcheckpointを使ったマージモデルの作り方

Stable Diffusion Web UIでは、複数のcheckpointを組み合わせてカスタムマージモデルを作成することができます。

マージとは複数のものを「結合する・融合する」という意味です。

自分用のモデルをカスタマイズできるので、画風やスタイルを固定することができます。

マージモデルの作成手順

下記のステップで進めて、Stable Diffusionで自分好みのマージモデルを作成してみましょう。

Hugging FaceやCivitaiで提供されているcheckpointモデルファイルを最低2つ選びます。

モデルに制限はなく、実写系モデル×アニメ・イラスト系モデルの組み合わせなどでも問題ありません。

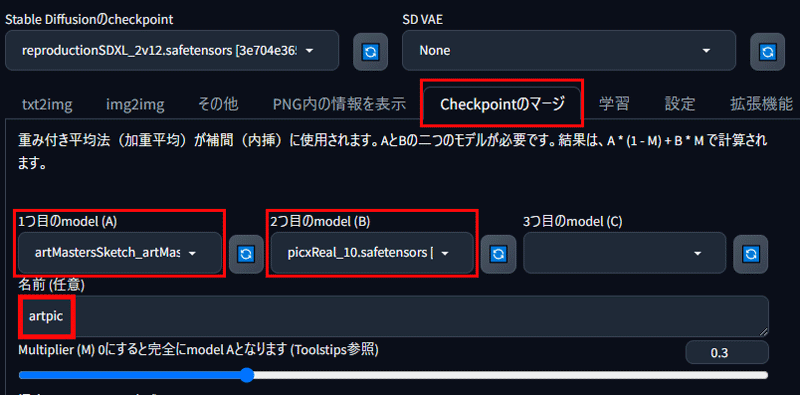

Checkpoint Mergerのタブから生成画面に切り替えます

checkpointモデルを2つ選択し、新しく作成するモデルに名前を付けます。

今回は「afterrealxl」と「reproductionSDXL」の2つのモデルを例にしてマージしていきます。

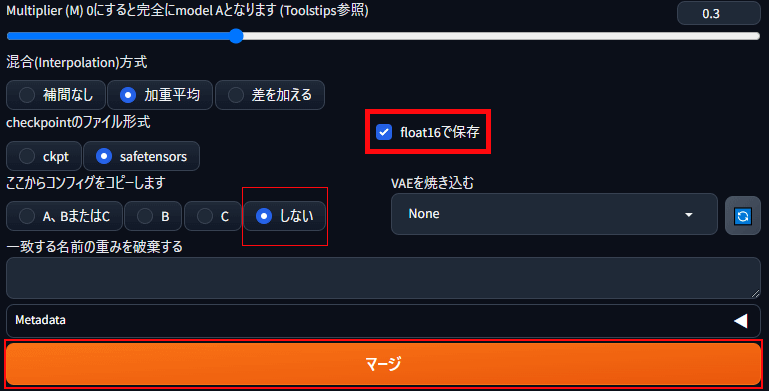

「float16で保存」は、作成後のモデルファイルを軽量化する機能なのでチェックを入れておきます。

「コンフィグをコピー」を「しない」にチェックを入れます。

その他の項目はデフォルト値で「マージボタン」を押して開始します。

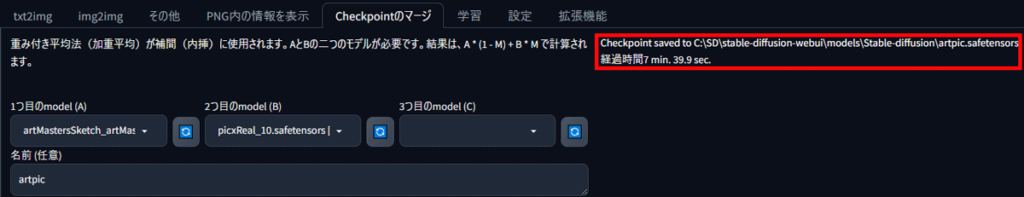

新しいcheckpointモデルがセーブされれば完了です。

マージモデルを使った画像の比較

実際にマージしたモデルを使って生成した画像を比較してみます。

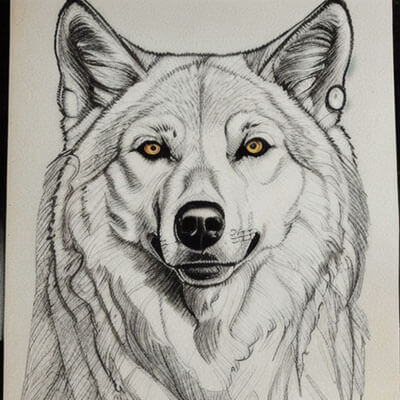

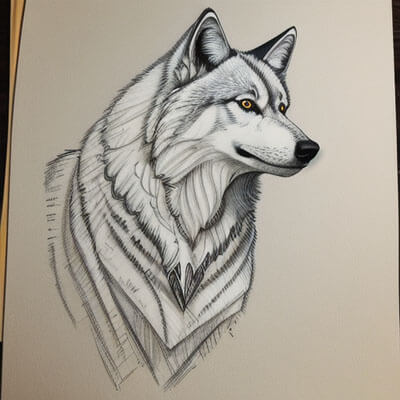

artMastersSketch

「artMastersSketch」は、スケッチ風の素材を学習したモデルです。

生成される画像は、テーマをキャンバスにスケッチした画風になります。

picxReal_10

「picxReal_10」は、リアルフォトの素材を基にしたモデルです。

生成される画像は、毛並みまで細かく描かれています。

artpic(合成比率50%マージ後)

「artMastersSketch」と「picxReal_10」2つのモデルをマージさせるとリアルなスケッチ画像が生成されます。

少し色味が付いた画像が生成されました。

Stable Diffusionを快適に使うならPICSOROBAN!

Stable Diffusionでcheckpointを快適に使いこなすには、16G以上のVRAMが推奨されています。

PCで利用する場合はグラボの増設やPCの買い替えまで必要となることもあります。

PICSOROBANを使えば、推奨環境を一切気にすることなく快適にStable Diffusionが利用できるのでおすすめです。

ブラウザで簡単!ピクソロ!

PICSOROBANは、インストールの必要なくブラウザで簡単にStable Diffusionを利用できます。

さらに、今ならリリースキャンペーンとして無料会員登録するだけで、2,000ポイント(約2時間分)貰えます!

詳しい使い方は下記の記事で紹介しています。

\今なら約2時間無料で使える!/

-

Stable Diffusionの口元プロンプト一覧|表情の作り方と崩れ修正テクニックを解説!

-

Stable Diffusionで同じ顔になる問題を解決!多様な顔を生成するテクニックを解説!

-

Stable Diffusionの靴・靴下プロンプト集|足元を魅力的に描く呪文まとめ

-

Stable Diffusionファンタジー服装プロンプト集|職業・ジョブ別の呪文一覧

-

Stable Diffusionの眉毛プロンプト(呪文)一覧!太さ・形・表情を操る

-

【2026年最新】Stable Diffusion実写系モデルのおすすめ5選!リアルな人物を作る呪文も解説