2025年8月5日、OpenAIはオープンソースモデル gpt-oss-120bとgpt-oss-20bを公開しました。

gpt-ossは、ChatGPTをローカル環境で自由に使える初のツールであり、使い方次第でさまざまな可能性を秘めています。

この記事では、プログラミングやサーバーの知識に自信がない方でも安心して始められるよう、gpt-ossをクラウドGPUで動かすまでの全手順を、豊富な画像付きでわかりやすく解説します。

GPUSOROBAN

GPUSOROBANは、高性能なGPU「NVIDIA A4000 16GB」を業界最安値の1時間50円で使用することができます。

さらに、クラウドGPUを利用しない時は停止にしておくことで、停止中の料金はかかりません。

クラウドGPUを使えばいつでもStable Diffusionの性能をフルに引き出すことができるので、理想の環境に近づけることができます。

\快適に生成AI!1時間50円~/

gpt-ossとは?

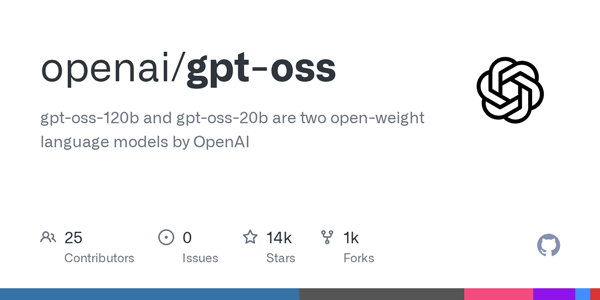

gpt-ossは、OpenAIが2025年8月に公開したオープンソースの大規模言語モデル(LLM)です。

モデルのパラメータ(ウェイト)が公開されており、個人・企業問わず自由に利用やカスタマイズが可能なのが最大の特徴です。

高い推論能力と効率性を兼ね備え、低コストで運用できるため、幅広い分野での活用が期待されています。

OpenAI GPT-OSS の主なポイント

• オープンウェイトモデル: OpenAIがリリースしたオープンソースAIモデル

• 2つのモデルサイズ: gpt-oss-120b(117Bパラメータ)とgpt-oss-20b(21Bパラメータ)の2つのバージョンを提供

• ローカル実行可能: ラップトップや個人のコンピューターでローカルダウンロードしてオフラインで使用可能

• Apache 2.0ライセンス: Apache 2.0ライセンスの下で自由に利用可能

• 開発者向け用途: 強力な推論、エージェントタスク、および多様な開発者用途に設計

• Hugging Faceで配布: オンライン開発プラットフォームHugging Faceから無料でダウンロード可能

• マルチプラットフォーム対応: macOSなど様々なプラットフォームで効率的に動作するよう最適化

gpt-ossをクラウド環境(ローカル)で利用する方法

ここでは、インターネット上で高性能なGPUを利用できるクラウドサービス「GPUSOROBAN」でgpt-oss を使う方法を解説していきます。

GPUSOROBANは、国内で運用されているクラウドサーバーで安全に管理されています。

まず、GPUSOROBANを利用するために、会員登録からセットアップまでを完了させる必要があります。

詳しい手順については、以下のリンクをご参照してください。

GPUSOROBANの会員登録とセットアップ方法

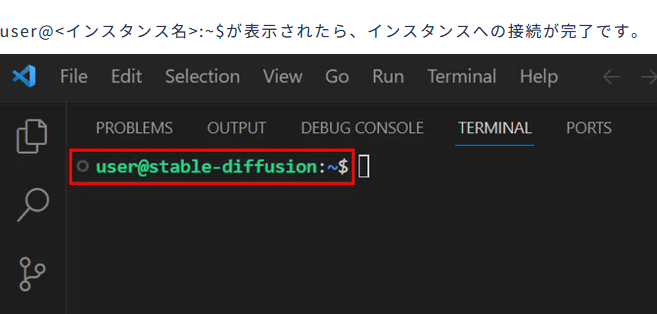

GPUSOROBAN起動チュートリアルに従い、インスタンスの起動とSSH接続を完了させます。

「user@<インスタンス名>:~$」が表示されたら、インスタンスへの接続が正常に完了したことを確認できます。

Ollamaのインストールが済んでいる方はステップ3に移動します。

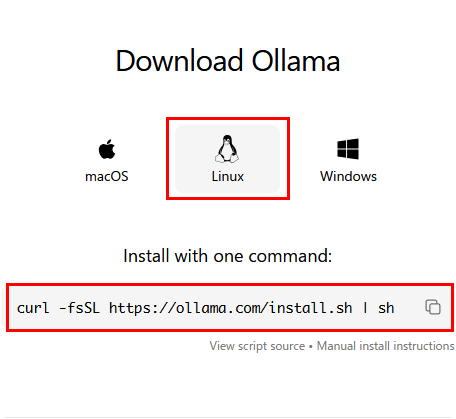

Ollamaの公式ページからLinuxを選択してコマンドをコピーします。

curl -fsSL https://ollama.com/install.sh | sh

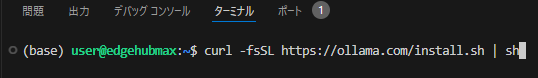

~$の後に貼り付けてインストールを実行します。

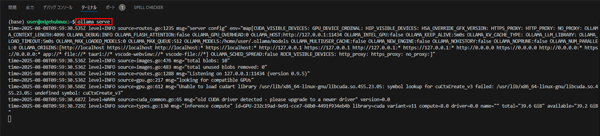

インストールが完了したら、下記コマンドを入力してOllamaを起動します。

ollama serve

Ollamaの公式ページからLinuxを選択してgpt-oss用の起動コマンドをコピーします。

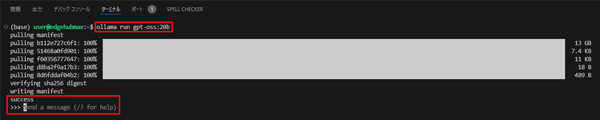

ollama run gpt-oss:20b

~$の後に貼り付けてダウンロードを実行します。

ダウンロードが終わるとそのままプロンプトの入力画面が表示されます。

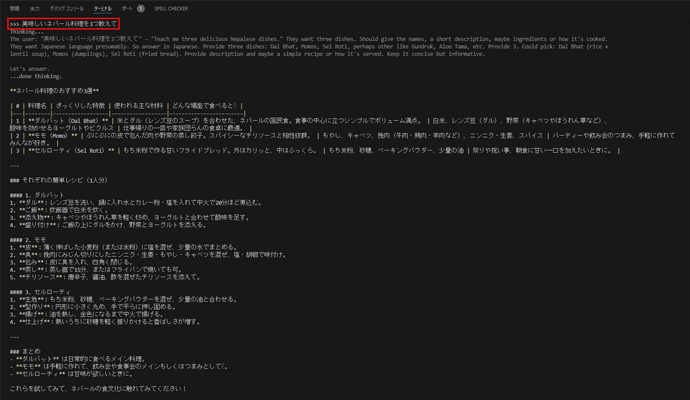

美味しいネパール料理を3つ教えてもらいます。

少し時間がかかりましたが、回答をしっかりまとめてもらえました。

ネパール料理のおすすめ3選

ネパール料理のおすすめ3選

| メニュー | 料理名 | ざっくりした特徴 | 使われる主な材料 | どんな場面で食べる? |

|---|---|---|---|---|

| 1 | ダルバット(Dal Bhat) | 米とダル(レンズ豆のスープ)を合わせた、ネパールの国民食。食事の中心に立つシンプルでボリューム満点。 | 白米、レンズ豆(ダル)、野菜(キャベツやほうれん草など)、酸味を効かせるヨーグルトやピクルス | 仕事帰りの一皿や家族団らんの食卓に最適。 |

| 2 | モモ(Momo) | ぷにぷにの皮で包んだ肉や野菜の蒸し餃子。スパイシーなチリソースと相性抜群。 | もやし、キャベツ、挽肉(牛肉・鶏肉・羊肉など)、ニンニク・生姜、スパイス | パーティーや飲み会のつまみ、手軽に作れてみんなが好き。 |

| 3 | セルローティ(Sel Roti) | もち米粉で作る甘いフライドブレッド。外はカリッと、中はふっくら。 | もち米粉、砂糖、ベーキングパウダー、少量の油 | 祭りや祝い事、朝食に甘い一口を加えたいときに。 |

それぞれの簡単レシピ(1人分)

1. ダルバット

- ダル:レンズ豆を洗い、鍋に入れ水とカレー粉・塩を入れて中火で20分ほど煮込む。

- ご飯:炊飯器で白米を炊く。

- 添え物:キャベツやほうれん草を軽く炒め、ヨーグルトと合わせて酸味を足す。

- 盛り付け:ご飯の上にダルをかけ、野菜とヨーグルトを添える。

2. モモ

- 皮:薄く伸ばした小麦粉(または米粉)に塩を混ぜ、少量の水でまとめる。

- 具:挽肉にみじん切りにしたニンニク・生姜・もやし・キャベツを混ぜ、塩・胡椒で味付け。

- 包み:皮に具を入れ、四角く閉じる。

- 蒸し:蒸し器で15分、またはフライパンで焼いても可。

- チリソース:唐辛子、醤油、酢を混ぜたチリソースを添えて。

3. セルローティ

- 生地:もち米粉、砂糖、ベーキングパウダーを混ぜ、少量の油と合わせる。

- 型作り:円形に小さく丸め、手で平らに押し固める。

- 揚げ:油を熱し、金色になるまで中火で揚げる。

- 仕上げ:熱いうちに砂糖を軽く振りかけると香ばしさが増す。

まとめ

- ダルバット は日常的に食べるメイン料理。

- モモ は手軽に作れて、飲み会や食事会のメインもしくはつまみとして◎。

- セルローティ は甘味が欲しいときに。

これらを試してみて、ネパールの食文化に触れてみてください!

gpt-ossを利用するメリット

ChatGPTはこれまでクローズドな「ブラックボックス」型のモデルでしたが、オープンソース化された gpt-oss は内部構造や動作原理が公開され、透明性が大幅に向上しました。

ここでは、主なメリットを4つにまとめます。

1. 高いカスタマイズ性と柔軟性

オープンソースのため、プログラムコードやモデル構造(アーキテクチャ)がすべて公開されています。

開発者は自社の目的や業界ニーズに合わせて自由にカスタマイズや拡張ができ、独自のAIソリューションを容易に開発可能です。

2. コストの削減と商用利用の自由

「gpt-oss」は、Apache 2.0という非常に自由度の高いライセンスで公開されています。

ライセンス料やAPI利用料が不要で、商用利用・改変・再配布が可能なため、自社環境での利用によってコストを大幅に削減できます。

3. セキュリティとプライバシーの強化

API型サービスとは異なり、社内サーバーやローカル環境(オンプレミス)で直接実行可能です。

機密情報や個人情報を外部に送信せず、安全な環境でAIを活用できます。

4. ローカル環境での手軽な利用

小規模モデル「gpt-oss-20b」は、16GB程度のVRAMを搭載した一般的なGPUやノートPCでも動作させることが可能です。

これにより、専門的なインフラを持たない個人開発者や小規模なチームでも、手軽に高性能なAIを試し、開発に組み込めます。

gpt-ossは、安全に使用すれば世代最強の対話型AI!

gpt-ossは、安全に運用すれば世代最強クラスの対話型AIです。

しかし、その高性能を十分に発揮するには強力なGPU環境が必要なため、初期投資を抑えつつ柔軟に利用できるクラウドGPUサービスが、多くの企業や開発者にとって最適な選択肢となります。

GPUSOROBANは、高性能なGPU「NVIDIA A4000 16GB」を業界最安値の1時間50円で使用することができます。

さらに、クラウドGPUを利用しない時は停止にしておくことで、停止中の料金はかかりません。

クラウドGPUを使えばいつでもStable Diffusionの性能をフルに引き出すことができるので、理想の環境に近づけることができます。

\快適に生成AI!1時間50円~/