Stable Diffusionの高速化は、高品質な画像生成を効率化する重要課題です。

GPUリソースの消費を抑え、快適な制作環境を実現するため、設定や拡張機能を徹底解説します。

Stable Diffusion高速化のための設定

Stable Diffusionには、高速化させるための機能設定があります。

今回は、WindowsとMacに分けておすすめの設定を紹介します。

Windowsの高速化

Stable DiffusionをWindows環境で高速に動作させるためには、PCの環境に合わせて起動オプションを導入するのが一般的です。

その他にもドライバの更新やCPUやメモリの最適化を行う方法があります。

ここでは、Stable DiffusionをWindowsで高速化する方法をいくつかご紹介します。

xformersを導入する

「xformers」はStable Diffusionでの画像生成を最適化するだけでなく、VRAMの使用量も抑えてくれる機能で、導入後は最大約2倍の生成速度となります。

xformersの導入は、利用メモリ量に余裕がない低スペックのGPUほど効果を発揮する特徴があります。

ただし、xformersを導入できるのは、NVIDIA製のGPUを利用しているPC環境のみなので注意しましょう。

設定方法は簡単で、起動ファイルに以下のように1行のスクリプトを追加するだけです。

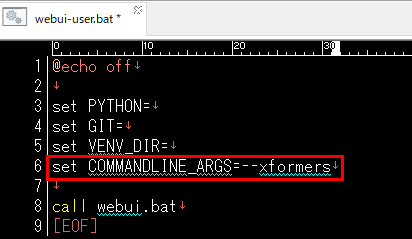

「webui-user.bat」ファイルを開いて編集します。

6行目のset COMMANDLINE_ARGS=の後に-xformersを入力して保存します。

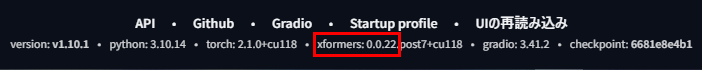

Stable Diffusionを起動して画面下部にxformersが実装されているのを確認します。

「低VRAM」オプションを追加する

VRAMの少ないPC環境でStable Diffusionを高速化して動作させるために、オプションを付けて起動します。

VRAM使用量を節約してソフトウエアを起動することで全体の動きが軽くなり、高速化につながります。

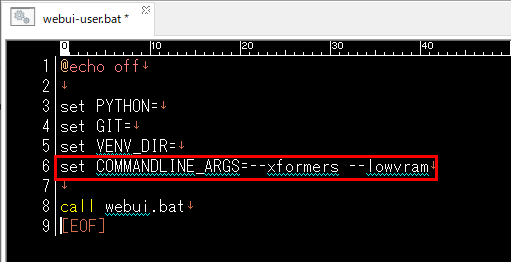

設定方法はxformersと同じで、起動ファイルに1行のスクリプトを追加するだけです。

下の画像のように–medvram(効果:中)と–lowvram(効果:強)を使い分けます。

その他のオプションを使う

その他にもStable Diffusionを高速化させるオプションには以下があります。

- –skip-prepare-environment

環境の準備をスキップするオプションで、環境の準備をスキップすることで起動が早くなり、Stable Diffusionが高速化します。

- –skip-torch-cuda-test

CUDAが正常に動作するかのチェックをスキップするオプションです。

ただし、異常が起きた場合に検知できないので、急いでいる場合にのみ使うようにしましょう。

Macの高速化設定

AppleのMac製品では、Stable Diffusionを利用し始めた時に、動作が全体的に遅く感じられるという意見が多くあります。

しかし、いくつかの設定を変更することで、Stable Diffusionの動作が改善されるので、有効に利用しましょう。

FP16設定

FP16(半精度浮動小数点)設定とは、数値の精度を少し下げる代わりに、処理のスピードを大幅に高速化させる技術です。

–no-halfオプションを利用してFP32で画像生成をしている場合は、オプションを外してFP16を有効化することで画像生成時間を高速化できます。

[webui-macos-env.sh]ファイルを編集して–no-halfオプションを外せば完了です。

Core MLで最適化する

Core MLとは、Appleが公開している機械学習フレームワークです。

iOSアプリで動作する機械学習モデルをサポートし、メモリ占有量と電力消費量を最小限に最適化するように設計されています。

Core ML 用に最適化された Stable Diffusionを利用することで高速化が実現できます。

ただし、環境構築からセットアップまでは、専門的な知識が必要となりますので、腕に自信がある方はチャレンジしてみましょう。

Stable Diffusionの使い方は、機能別に下記の記事にまとめているのでぜひご覧ください

Stable Diffusion高速化のための拡張機能

拡張機能を使ってStable Diffusionを高速化する方法を紹介します。

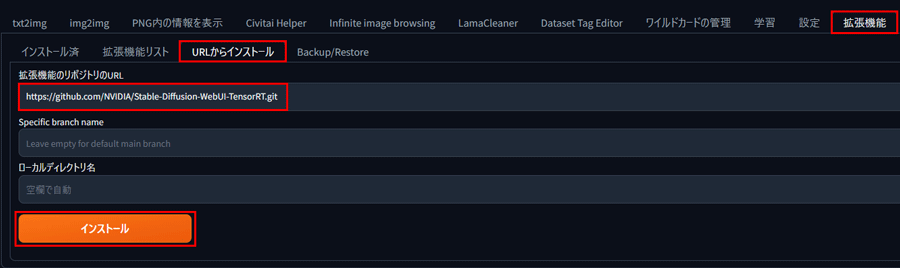

Stable-Diffusion-WebUI-TensorRT

Stable-Diffusion-WebUI-TensorRTは、NVIDIAが開発した拡張機能で、NVIDIA製のGPU上で行う画像生成の時間を高速化できます。

ただし、NVIDIA以外のGPUに対しては使用効果がないので注意しましょう。

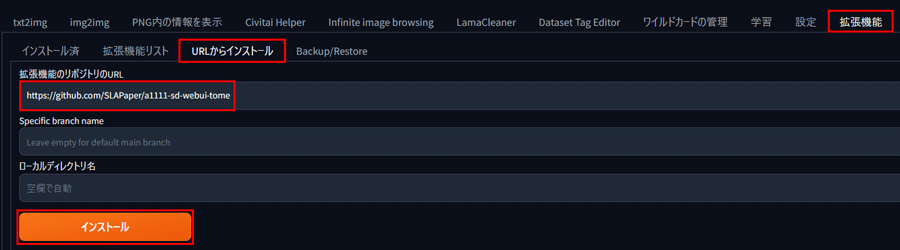

拡張機能タブから「URLからインストール」を選択し、リポジトリのURLを入力します。

https://github.com/NVIDIA/Stable-Diffusion-WebUI-TensorRT.git

※2025年2月現在、TensorRTはUbuntuOSで利用できないエラーが報告されています。

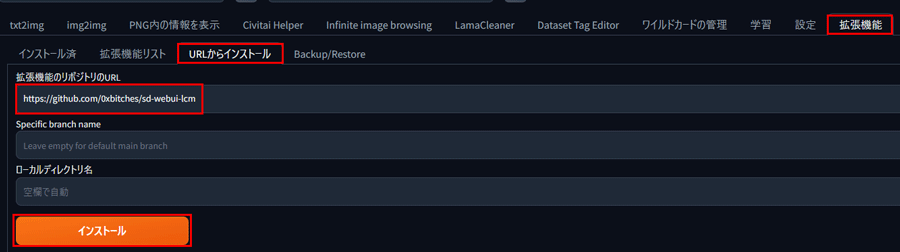

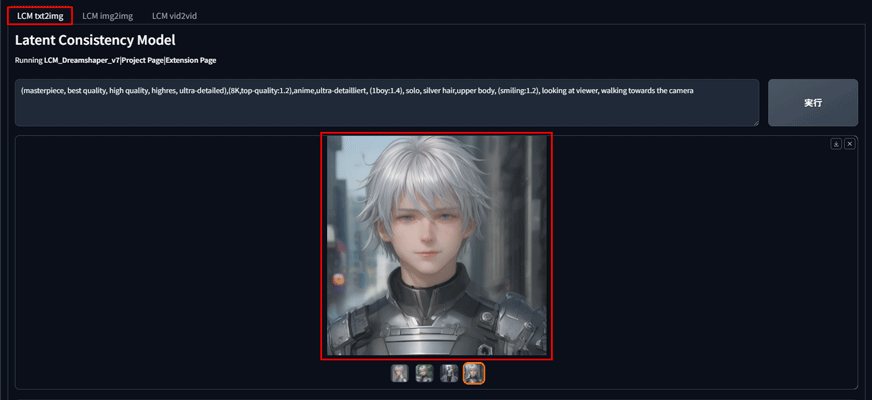

sd-webui-lcm

LCMとはLatent Consistency Model(潜在一貫性モデル)の略で、画質よりも生成速度を優先する仕組みです。

LCMは生成モデルの一種で、高い品質の出力を効率的に得るため、生成時に少ないステップ数で画像生成をアプローチし、高速化します。

https://github.com/0xbitches/sd-webui-lcm

インストール後は、LCMの専用タブから機能を利用します。

高い画質の画像でも高速化でき、短時間で生成が完了します。

ToMe

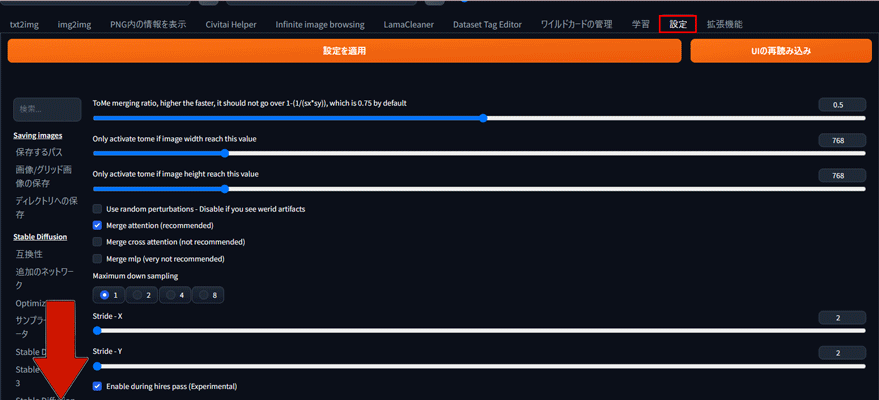

「ToMe」とは、Token Mergingの略で、画像の似ているピクセルをマージすることで計算量を減らし、画像生成を高速化する機能です。

主にアップスケーラーを利用して画像を高画質化する際に効果を発揮します。

https://github.com/SLAPaper/a1111-sd-webui-tome

「設定」タブから下部のToMe Settingsを開いてパラメーターを調整します。

インストール後にシード値の下にある「Enable ToMe optimization」にチェック入れることで生成時に適用されます。

Stable Diffusion高速化のためのモデル管理

モデルを利用してStable Diffusionを高速化する方法を紹介します。

高速化するように適用されたモデルやLoRAは、生成時に使用すればよいだけなので手軽と言えるでしょう。

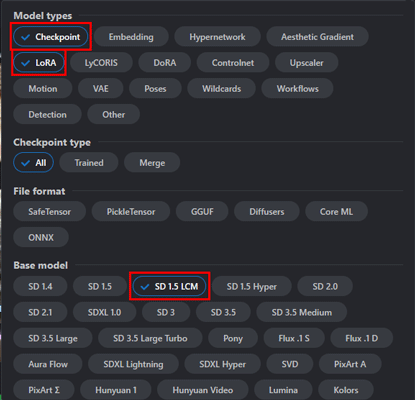

LCMモデルを使う

LCM (Latent Consistency Model) とは、モデルを別モデルに蒸留(圧縮)することで生成に必要なステップ数を減らして高速化する手法です。

LCMモデルは、Civitaiのモデルページからダウンロードすることで利用できます。

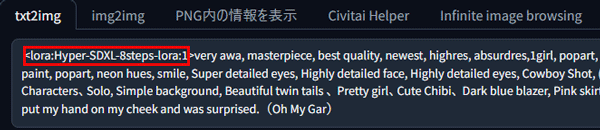

Hyper-SD を使う

Hyper-SDとは、細かいステップごとに学習と蒸留を行いながらステップ数を減らし、高品質な画像を生成できるようにする高速化の手法です。

こちらからLoRAファイルをダウンロードし、通常のLoRAに含めて利用します。

少ないステップ数で、通常よりも大幅に高速化できます。

Stable Diffusionの呪文を最大限活用するにはPICSOROBANがおすすめ

Stable Diffusionの呪文を最大限活用するには、生成回数を重ねて仕上げていく必要があります。

効率的にStable Diffusionで画像を生成するには、16GB以上のVRAMが搭載されたパソコンの利用がおすすめです。

しかし、高性能なパソコンの多くがが30万円以上と高額になります。

そのような時は、PICSOROBANがおすすめです。

コストを抑えたい方へ:今のパソコンのまま使える「PICSOROBAN」

ピクソロのメリット

- すぐ使える:高額PC不要で、ブラウザからすぐに利用可能。必要な分だけポイントを購入できます。

- リーズナブル:30分約60円で利用可能。さらに今なら約2時間分が無料。

- 無制限作成:時間内であれば、何枚でも画像生成可能。短時間で多くの作品を生成できます。

PICSOROBANは、インストールの必要なくブラウザで簡単にStable Diffusionを利用できます。

さらに、今ならリリースキャンペーンとして無料会員登録するだけで、2,000ポイント貰えます!

詳しい使い方は下記の記事で紹介しています。

\約2時間無料で使える!/

Stable Diffusionが快適に使えるおすすめのパソコンやグラボに関しては下記の記事で紹介しています。