Black Forest Labsは、2025年11月に画像生成AIモデルの最新バージョンである「FLUX.2」をリリースしました。

Flux(フラックス)とは、Stable DiffusionやComfyUIなどで利用できる画像生成AIのベースモデルです。

本記事では、この注目のモデルである「FLUX.2」の概要から、インストール前の準備、具体的な設定方法、基本的な使い方、応用テクニックを解説します。

FLUX.2とは?

FLUX.2は、文章から画像を作ることと、手持ちの画像を素材にして画像を編集することができる生成AIモデルです。

最大約4メガピクセル級の高解像度画像を高速で生成することができます。

FLUX.2の技術的な特徴

FLUX.2で公式に公開されている技術は以下の通りです。

- FLUX.2は、長めで複雑な指示や細かなレイアウト指定、一般的な知識を含む指示でも、意図に沿った画像を作るのが得意です。

- 細かい文字やボタンなどのUI要素、インフォグラフィック、ロゴといったタイポグラフィ表現が改善されています。広告用の画像、提案資料の図版、アプリやWebのUIモックなど、実務で使えるクオリティの成果物を作りやすいのが特徴です。

FLUX.2のラインナップ

FLUX.2で公開されているラインナップは4種類で、それぞれ特徴があります。

各グレードによって配信方法が異なるので、利用前に確認しましょう。

- FLUX.2 [pro]

-

- 特徴:クローズドモデル最上位クラスに匹敵する画質が特徴です。プロンプト忠実度と視覚的再現性に優れ、さらに高速・低コスト。スピードと品質のトレードオフを極小化しています。

- ユースケース:本番運用、商用サービスへの組み込み、品質重視の制作ワークフローで利用されます。

- 入手・利用:BFL Playground、BFL API、およびローンチパートナー経由で提供中です。

- FLUX.2 [flex]

-

- 特徴:ステップ数、ガイダンススケールなどのパラメータを調整可能です。品質・忠実度・速度のバランスを開発者側で最適化でき、文字表現や微細ディテールの描画が得意です。

- ユースケース:実験・検証、細部制御が必要なデザインや資料作成、プロンプト調整を前提としたワークフローで利用されます。

- 入手・利用:bfl.aiでのお試しplay、BFL API、ローンチパートナーで利用が可能になっています。

- FLUX.2 [dev]

-

- 概要:FLUX.2ベースから派生した32Bのオープンモデルです。現時点で最強クラスの「オープンウェイトの画像生成・編集モデル」として登場しました。

- 特徴:テキストからの画像生成と、複数画像を使った編集を1つのチェックポイントでサポート。参考推論コードを使ってローカル実行が実現しています。NVIDIAおよびComfyUIとの協業による最適化fp8実装により、GeForce RTXなどの一般的GPUでも動作が可能です。

- 入手・利用方法:Hugging Faceでモデルデータが配布中です。ローカル実行が可能で、公式のリファレンス推論コードを使用できます。

- クラウド/ホスティングAPI:FAL、Replicate、Runware、Verda、TogetherAI、Cloudflare、DeepInfra経由でサンプリングが可能です。

- FLUX.2 [klein](近日公開・ベータ参加受付中)

-

- 概要:FLUX.2ベースからサイズ蒸留された小型モデルです。オープンソース(Apache 2.0)として提供予定。

- 特徴:同等サイズ帯でゼロから学習したモデルより強力で、教師モデル(FLUX.2ベース)に近い多くの能力を継承します。開発者フレンドリーの設計になっています。

- ステータス:Coming soon。ベータ参加受付中になっています。

Stable Diffusionの使い方は、機能別に下記の記事にまとめているのでぜひご覧ください

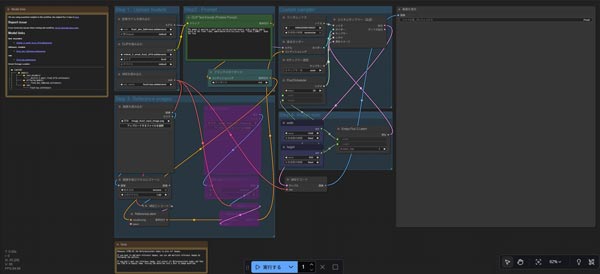

FLUX.2 ComfyUIでの始め方・使い方

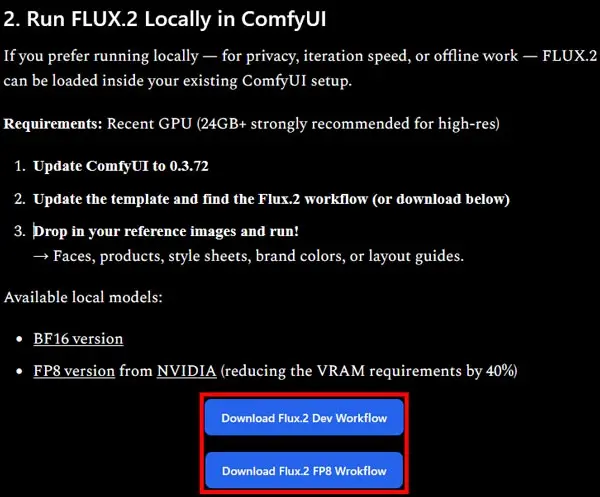

ここでは、「ComfyUI」を使ったローカル環境でのFLUX.2 [dev]の始め方から使い方まで紹介します。

ComfyUIの導入方法はこちらの記事で詳しく解説しています。

FLUX.2は、多くのGPUパワーが必要になりますので、余裕をもって準備をしておきましょう。

今回は、FLUX.2 [dev]のBF16(通常版)を使用して画像を生成してみます。

導入前に「ComfyUI」を起動して最新版に更新しておきましょう。

更新が完了したらデータのインストールに進みます。

次に、画像を生成するためのモデルデータを入手します。

画像生成に必要なモデルデータは下記の3つです。

- 画像のモデルデータ

- テキストエンコーダー

- VAE

画像のモデルデータ

動画のモデルデータをHugging Faceからダウンロードします。

- flux2_dev_fp8mixed.safetensors(33.02 GB)

「ComfyUI」>「models」>「diffusion_models」を開き、下記のコマンドを入力して動画のモデルデータをダウンロードして配置します。

cd ComfyUI/models/diffusion_models

wget https://huggingface.co/Comfy-Org/flux2-dev/resolve/main/split_files/diffusion_models/flux2_dev_fp8mixed.safetensorsテキストエンコーダー

動画のモデルデータをHugging Faceからダウンロードします。

- mistral_3_small_flux2_bf16.safetensors(33.14GB)

「ComfyUI」>「models」>「text_encoders」を開き、下記のコマンドを入力して動画のモデルデータをダウンロードして配置します。

cd ComfyUI/models/text_encoders

wget https://huggingface.co/Comfy-Org/flux2-dev/resolve/main/split_files/text_encoders/mistral_3_small_flux2_bf16.safetensorsVAE

次にVAEのモデルデータをHugging Faceからダウンロードします。

- flux2-vae.safetensors(320MB)

「ComfyUI」>「models」>「vae」を開き、下記のコマンドを入力してVAEのモデルデータをダウンロードして配置します。

cd ComfyUI/models/vae

wget https://huggingface.co/Comfy-Org/flux2-dev/resolve/main/split_files/vae/flux2-vae.safetensors今回は公式で配布されている総合ワークフローを使用します。

ワークフローデータは、公式に公開されている公式ワークフローをダウンロードして使用します。

BF16は通常版、FP8は軽量版モデルでVRAMの負荷が40%ほど軽減されます。

ダウンロードしたワークフローデータをComfyUIの画面にドラッグ&ドロップで読み込みます。

ノードが正常に反映されているか確認します。

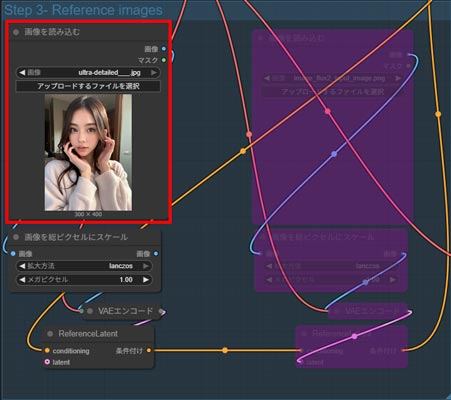

FLUX.2の生成には、参照する素材の画像とプロンプトが必要です。

素材画像は、キャラクター、製品、スタイル、ブランドカラー、レイアウトなどの要素を参照します。

・素材画像

生成画像に固定させたいキャラクター画像をアップロードします。

キャラクターの特徴をメモしておき、崩したくない内容をプロンプトに入力します。

その他のパラメータはデフォルトのままで問題ありません。

プロンプトを入力して、画面上部の「▷Queueボタン」の右側に数字を入力する欄あるので生成したい画像の枚数を指定します。

その後「▷Queue」ボタンをクリックして生成を開始します。

The woman is wearing a small pale yellow knitted beanie, with a white fabric patch on the front right, embroidered with big gray text “EdgeHub ♬” Kepp the face

FLUX.2(ComfyUI)で生成した画像

スポンサーリンク

FLUX.2の料金プランと商用利用は?

FLUX.2の料金プランと商用利用について解説します。

FLUX.2の料金プランは?

FLUX.2の料金プランは、使用するモデルのグレードによって変わります

こちらの比較テーブルを参考にしてFLUX.2を実用してみましょう。

| モデル名 | 料金タイプ | ライセンス | 特徴 | 主な用途 | 提供状況 |

|---|---|---|---|---|---|

| FLUX.2 [pro] | クローズド・API(有料) | 商用 | 最高品質。高速・低コスト。品質とスピードの両立 | 本番運用、商用サービス組み込み | ✅ 提供中 |

| FLUX.2 [flex] | マネージドAPI(有料) | 商用 | パラメータ調整可能(ステップ数、ガイダンス等)。文字・細部描画が得意 | 実験・検証、細部制御が必要なデザイン | ✅ 提供中 |

| FLUX.2 [dev] | オープンモデル(無料) | 要商用ライセンス | 最強クラスのオープンモデル。画像生成+編集を統合。ローカル実行可能 | ローカル実行、カスタム拡張、研究 | ✅ 提供中 |

| FLUX.2 [klein] | オープンソース(小型) | Apache 2.0 | サイズ蒸留モデル。同サイズ帯で最強クラス。開発者フレンドリー | 軽量組み込み、OSS活用 | 🔜 近日公開(ベータ受付中) |

| FLUX.2 – VAE | VAE基盤モデル(無料) | Apache 2.0 | 全FLUX.2の土台。学習容易性・画質・圧縮率を最適化 | モデル基盤研究、実装 | ✅ 提供中 |

FLUX.2の商用利用は?

GitHubで公開されている公式プロジェクトはApache 2.0ライセンスのもとで提供されており、自由にコードを利用できます。

具体的には、以下のような利用例が許可されています。

- 商用利用

- コードの改変・再配布

- 特許の使用

ただし、今後、サービス提供時にライセンスが変更される可能性もあるため、商用プロジェクトで利用する際は、最新のライセンス情報を必ず確認しましょう。

FLUX.2のような画像生成AIにはクラウドGPUがおすすめ

FLUX.2で高画質の画像を生成するには、高スペックなパソコンが必要です。

ただし、FLUX.2を快適に利用できるような高性能なパソコンは、ほとんどが30万円以上と高額になります。

コストを抑えたい方へ:クラウドGPUの利用がおすすめ

クラウドGPUとは、インターネット上で高性能なパソコンを借りることができるサービスです。これにより、最新の高性能GPUを手軽に利用することができます。

クラウドGPUのメリット

- コスト削減:高額なGPUを購入する必要がなく、使った分だけ支払い

- 高性能:最新の高性能GPUを利用できるため、高品質な画像生成が可能

- 柔軟性:必要なときに必要なだけ使えるので便利

FLUX.2を使いこなして最先端画像生成AIをマスターしよう!

今回は、画像生成AI・FLUXの最新バージョン「FLUX.2」の使い方について紹介しました。

無料で利用できる画像生成AIのオープンソースの中でトップクラスなので、このチャンスに高性能ツールで画像生成を極めてみましょう。