「Qwen Image」は、Alibaba Cloudが開発した画像生成AIです。日本語での指示を正確に理解し、高精度な画像を生成できる点から、今大きな注目を集めています。

そのポテンシャルを最大限に引き出すなら、ノードベースで柔軟なワークフローを組み立てられる「ComfyUI」との組み合わせが最適です。

この記事では、Qwen Imageのインストール方法から具体的な使い方までをわかりやすく解説します。

Qwen Imageとは

Qwen Imageは、Alibaba Cloudが開発したテキストから画像を生成するAIモデルです。

これまで多くの画像生成AIが苦手としてきた、画像内に自然で正確な文字(テキスト)を描画できる点に優れているのが大きな特徴です。

さらに、単に画像を生成するだけでなく、キャラクターのポーズ変更やスタイル変更といった高度な編集も行えます。

Stable Diffusionの使い方は、機能別に下記の記事にまとめているのでぜひご覧ください

Qwen Imageのインストール手順

ここでは、Qwen Imageを利用するまでの手順を詳しく解説します。

今回は、ComfyUI上でのQwen Imageの使い方を解説します。

ComfyUIを起動するそれぞれの環境に合わせた手順を参考にして、スムーズにQwen Imageのセットアップを進めましょう。

ComfyUIをインストール

環境に合わせたインストール手順を参考にして、ComfyUIのセットアップを進めましょう。

WindowsPCにインストールする方法

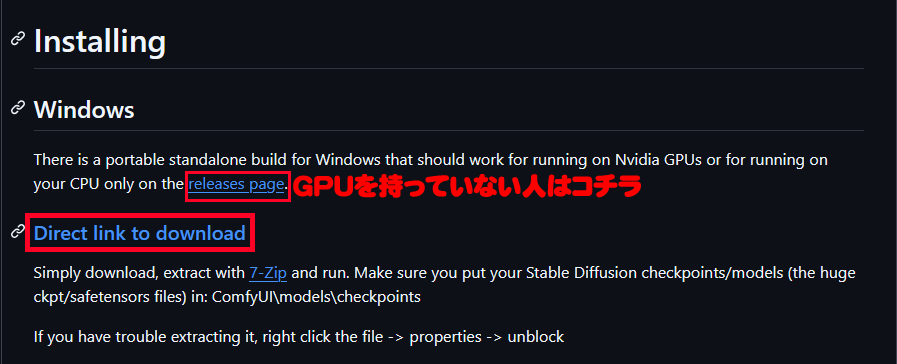

まずは、GitHubのComfyUI公式ページにアクセスし、必要なデータをダウンロードします。

Windows PCの場合、GPUを搭載しているPC向けと、非搭載のPC向けに分かれているため、自身の環境に適したバージョンを選びましょう。

ページの中部の「Installing」の項目からComfyUIの圧縮ファイルを探します。

「Direct link to download」をクリックすると、データのダウンロードが開始します。

データのダウンロードが完了するまで待ちます。

※ ファイルサイズは約1.3GBと比較的大きいので、安定したインターネット接続環境でのダウンロードをおすすめします。

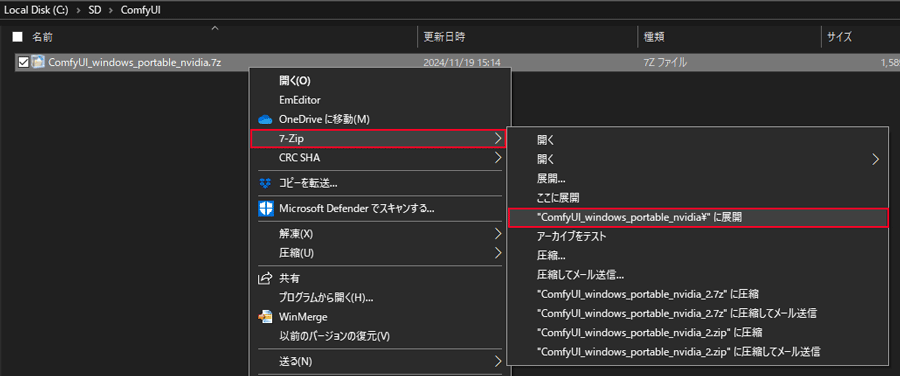

ダウンロードが完了したらデータを解凍します。

ファイルは 7-zip の形式で圧縮されてますので、専用の圧縮・解凍ソフトの利用がおすすめです。

解凍後の「ComfyUI_windows_portable_nvidia_cu121_or_cpu」フォルダを開きます。この中にある「ComfyUI_windows_portable」がソフトウェアの本体です。

ファイル名が長すぎたり、日本語を含むディレクトリに配置すると、エラーが発生する可能性があります。そのため、シンプルでアクセスしやすい場所に移動することをおすすめします。

例: Cドライブ直下に「SD」というフォルダを作成し、その中に「ComfyUI_windows_portable」を移動。

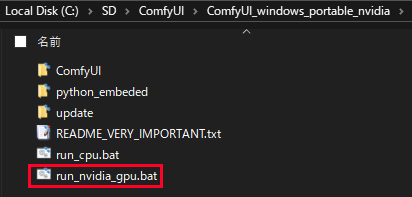

設置が完了したら「run_nvidia_gpu.bat」をダブルクリックして、ソフトを起動します。

起動後、既定のブラウザが自動で開き、ComfyUIの画面が表示されます。

GPUSOROBANにインストールする方法

ここでは、インターネット上で高性能なGPUを利用できるクラウドサービス「GPUSOROBAN」にComfyUIをインストールする方法を解説します。

まず、GPUSOROBANを利用するために、会員登録からセットアップまでを完了させる必要があります。

詳しい手順については、以下のリンクをご参照してください。

GPUSOROBANの会員登録とセットアップ方法

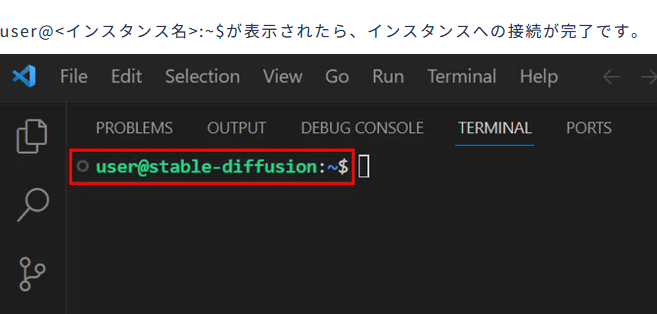

GPUSOROBAN起動チュートリアルに従い、インスタンスの起動とSSH接続を完了させます。

「user@<インスタンス名>:~$」が表示されたら、インスタンスへの接続が正常に完了したことを確認できます。

次に、GPUSOROBANのGPUインスタンス内にComfyUI専用の環境を作成します。

今回はMinicondaのConda環境を使ってComfyUIをセットアップしていきます。

conda create -n comfy python=3.10

conda activate comfy

pip install torch==2.5.1+cu118 torchvision --extra-index-url https://download.pytorch.org/whl/cu118ComfyUIの推奨バージョンはpython 3.10ですので、プロジェクト名を「Comfy」にしてGPUSOROBANのセットアップ通りに進めて完了すれば問題ありません。

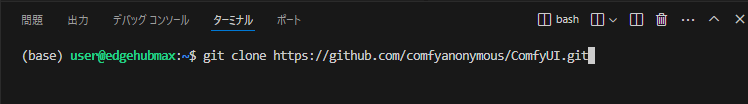

インスタンスを起動した状態でComfyUIをインストールします。

$の後に以下のコマンドを入力します。

git clone https://github.com/comfyanonymous/ComfyUI.git

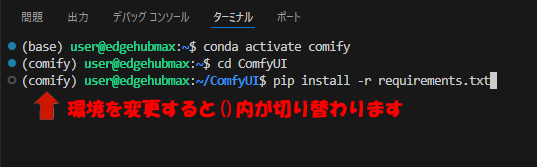

先ほど構築したComfyUI専用環境に切り替えてComfyUI最新版をインストールします。

conda activate comfy

cd ComfyUI

pip install -r requirements.txt

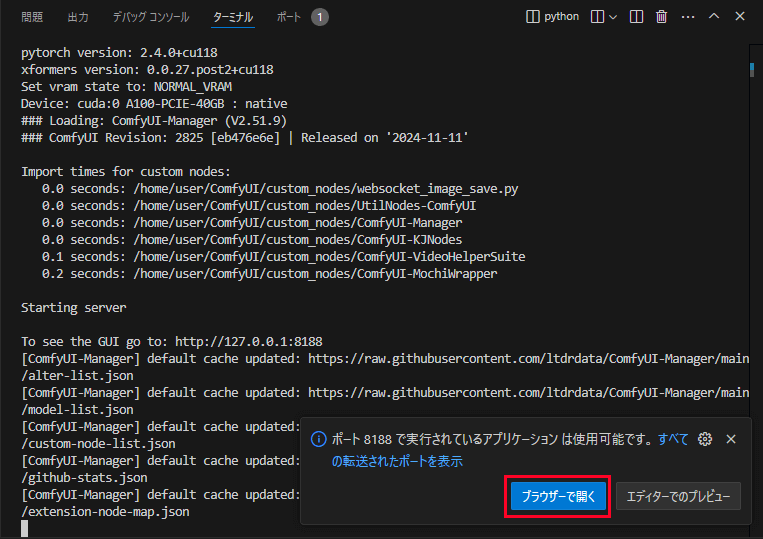

次のコマンドを実行してComfyUIを起動します。

python main.py

デバイス上の割り当てが失敗して起動がうまく行かない場合は–disable-cuda-mallocのオプションを付けて起動します。

python main.py --disable-cuda-malloc

ブラウザで開くボタンをクリックして起動完了になります。

Qwen Imageの使い方

ここからはQwen Imageの基本的な使い方を解説していきます。

以下のステップで、まずは基本的な使い方をマスターしましょう。

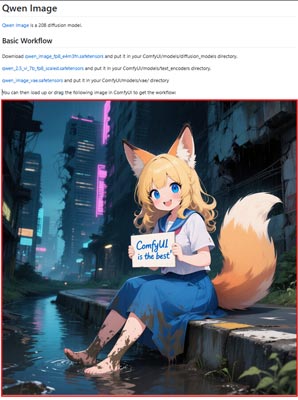

Qwen ImageのワークフローをComfyUIの公式サンプルページから入手します。

ワークフローは画像の中に埋め込まれているので、画像をブラウザからそのままダウンロードします。

ダウンロードした画像をComfyUIの画面にドラッグ&ドロップで画像を読み込むと埋め込まれているワークフローデータを表示することができます。

Qwen Image専用の学習モデルデータをHugging Faceからダウンロードしてセットアップします。

基本モデルのダウンロード(19.03GB)

cd ComfyUI/models/diffusion_models

wget https://huggingface.co/Comfy-Org/Qwen-Image_ComfyUI/resolve/main/split_files/diffusion_models/qwen_image_fp8_e4m3fn.safetensors

CLIPモデルのダウンロード(9.38GB)

cd ComfyUI/models/clip

wget https://huggingface.co/Comfy-Org/Qwen-Image_ComfyUI/resolve/main/split_files/text_encoders/qwen_2.5_vl_7b_fp8_scaled.safetensors

VAEのダウンロード(254MB)

cd ComfyUI/models/vae

wget https://huggingface.co/Comfy-Org/Qwen-Image_ComfyUI/resolve/main/split_files/vae/qwen_image_vae.safetensors

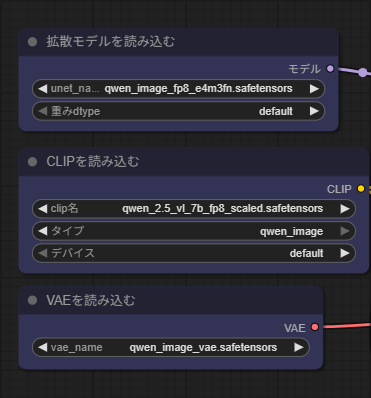

モデル: qwen_image_fp8_e4m3fn.safetensors(19.03GB)

テキストエンコーダー: qwen_2.5_vl_7b_fp8_scaled.safetensors (9.38GB)

VAE: qwen_image_vae.safetensors(254MB)

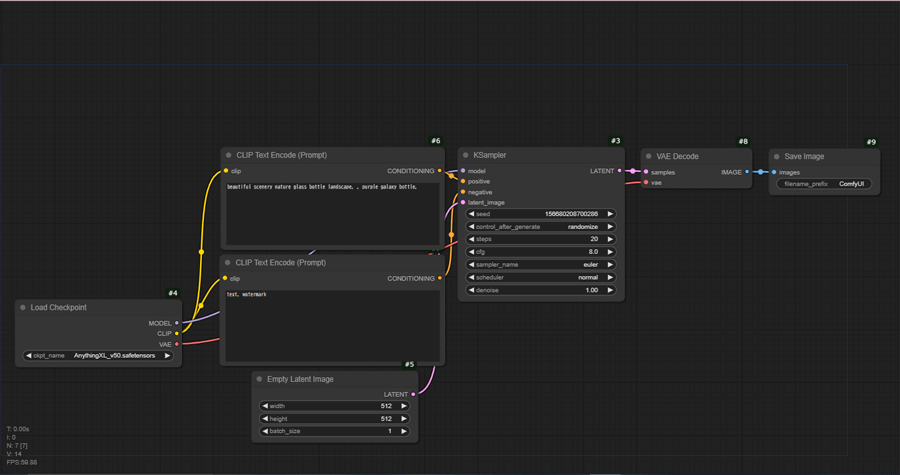

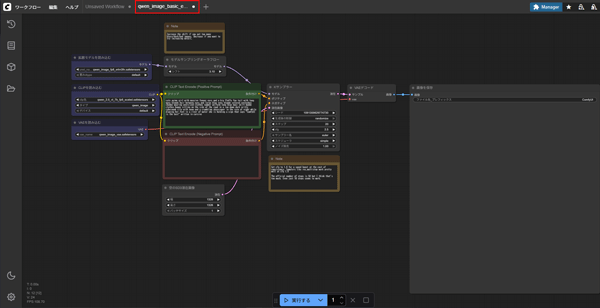

ComfyUIを起動して、Qwen Imageのワークフローファイルをドラッグ&ドロップで読み込みます。

全てのノードが正常に反映されているか確認します。

ワークフローで指定された3つのノードにモデルデータをセットします。

- 「拡散モデル」ノードに「qwen_image_fp8_e4m3fn.safetensors」を配置します。

- 「CLIP」ノードに「qwen_2.5_vl_7b_fp8_scaled.safetensors」を配置します。

- 「VAE」フォルダに「qwen_image_vae.safetensors」 を配置します。

次に、プロンプトを入力して画像生成を開始します。

右側にあるパネル上部の「Queue Prompt」ボタンをクリックして生成を開始します。

入力されている数値は、デフォルト値のままで問題ありません。

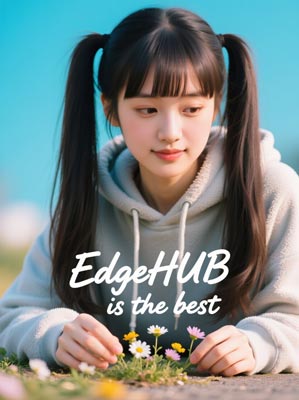

通常のプロンプトに加えて文字を表示する内容を加えて生成を開始します。

パーカー

ファンタジー

リアル

文字が正確に入力された画像が生成できました!

Qwen Imageの料金プランと商用利用は?

Qwen Imageの料金プランと商用利用について解説します。

Qwen Imageの公式プロジェクトはApache 2.0ライセンスのもとで提供されており、商用利用を含めて自由にコードを利用できます。

ただし、再配布やコードの改変時に配布する際には、著作権表示とライセンスの全文の記載が必要になります。

Qwen Imageの商用利用は?

Qwen ImageはApache 2.0ライセンスのもとで提供されており、商用利用を含めた幅広い用途での利用が認められています。

具体的には、以下のような利用例が許可されています。

- 商用利用

- コードの改変・再配布

- 特許の使用

ただし、今後、サービス提供時にライセンスが変更される可能性もあるため、商用プロジェクトで利用する際は、最新のライセンス情報を必ず確認しましょう。

Qwen Imageを最大限に楽しむなら、クラウドGPUが最適解!

Qwen Imageを快適に利用するなら、クラウドGPUの利用がおすすめです。

「Qwen Imageで理想のイラストを生成したいけど、PCのスペックが足りない…」 「生成に時間がかかりすぎて、快適に作業できない…」

そんな悩みを一瞬で解決するのが、クラウドGPUサービスです。

高価なグラフィックボードを自前で用意する必要はありません。最新・高性能なGPUを必要な時間だけレンタルし、Qwen Imageを驚くほど高速かつ快適に動作させることができます。

クラウドGPUのメリット

- コスト削減:高額なGPUを購入する必要がなく、使用した分だけの支払い

- 高性能:最新の高性能GPUを利用できるため、高品質な画像生成が可能

- 柔軟性:必要なときに必要なだけ使えるので便利

こんな人におすすめ

- 少ない予算でQwen Imageを快適に使いたい人

- 自分のパソコンの性能が不足していると感じる人

- 常に最新の高性能GPUを使いたい人

GPUSOROBAN

GPUSOROBANは、高性能なGPU「NVIDIA A4000 16GB」を業界最安値の1時間50円で使用することができます。

さらに、クラウドGPUを利用しない時は停止にしておくことで、停止中の料金はかかりません。

クラウドGPUを使えばいつでもStable Diffusionの性能をフルに引き出すことができるので、理想の環境に近づけることができます。

\快適に生成AI!1時間50円~/