Stable Diffusionの品質向上には「Clip skip」を使いこなすのが一番の近道です。

「Clip skip」は、プロンプトをどれだけ深く解釈するかを調整し、イラスト全体の完成度を高めることができます。

本記事では、Clip skipの仕組みから、アニメ風・リアル系といったモデルごとの最適な設定値まで、具体的な作例を交えた実践テクニックを紹介します。

Stable DiffusionのClip skipとは?プロンプトの解釈を調整する機能

StableDiffusionにおけるClip skipとは、プロンプト(テキスト指示)をAIが解釈する際の深さを調整する機能です。

画像生成AIは、CLIPという言語モデルを用いて入力されたテキストを理解しますが、その理解のプロセスは複数の層(レイヤー)で構成されています。

Clipskipの「skip」とは、この解釈プロセスの最終段階に近い層を、文字通り「スキップ(飛ばす)」ことを意味します。

- 値を上げるほど(例:1→2)細部の過剰強調を抑え、にじみ・破綻・ノイズを減らしやすい

- ネガティブプロンプトの効き方も変わるため、併用調整で安定度が向上する

- サンプラーやステップ数、CFG Scaleとの相互作用が強く、最適値はセットで決まる

- 主にモデル・SD1.5に適用される

- 複雑な長文プロンプトの「詰め込み過ぎ」による破綻を和らげ、要素の取捨選択が自然になりやすい

- 顔崩れ・指の破綻・背景の煩雑さを軽減する。一方でディテールや鋭さが若干マイルドになることがある

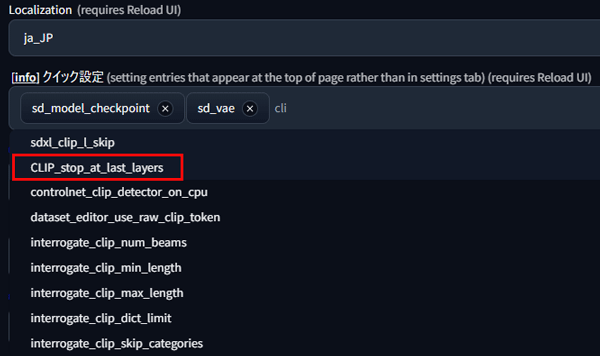

Clip skipの設定場所と変更手順を画像で解説

Stable Diffusion WebUIのClip skipの設定は、UIから簡単に行うことができます。

汎用性が高い機能なので、常に指定できるようにしておきましょう。

まず、画面上部にある「設定」タブをクリックし、左側のメニューから「ユーザーインターフェース」を選択します。

クイック設定で「CLIP_stop_at_last_layers」を検索してチェックを入れます。

表示が確認出来たら「Applysettings」ボタンをクリックして「UIの再読み込み」を行います。

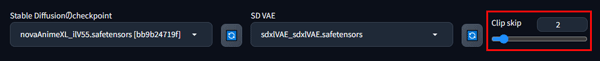

再読み込みを行うとTOP画面の上部にClipskipのスライダーが出現します

【SD1.5モデル】Clip skipの値による生成画像の比較【1~12まで検証】

Clipskipの設定値は、生成される画像のスタイルに直接的な影響を与えます。

Clipskipの値が「1」の場合はプロンプトの指示に最も忠実になろうとしますが、値を大きくしていくにつれて解釈が抽象的になり、画風が変化していきます。

ここでは、同じプロンプトとシード値を使い、Clipskipの値を1から12まで変更した場合に、生成される画像がどのように変わるかを比較検証してみます。

この変化を理解することで、自身の目指すイラストに最適な設定値を見つけることができるようになります。

Clipskipの値「1」:プロンプトの指示に最も忠実な仕上がり

Clipskipの値を「1」に設定すると、AIはプロンプトの情報を最後まで解釈して画像生成に利用します。

そのため、複雑な構図や細かい装飾といった、テキストの指示を最も忠実に再現しようとします。

写真のようなリアル系の画像や、キャラクターのポーズなどを厳密に指定したい場合に有効な設定です。

しかし、情報量が過多になることで、イラスト全体の調和が取れずに破綻してしまったりするケースもあります。

特にアニメ風のイラストモデルでは、絵が硬い印象になりがちで、意図しない崩れが発生する原因にもなります。

【オススメ】Clipskipの値「2」:画風と忠実さのバランスが取れた標準的な設定

Clipskipの値「2」は、多くのモデルで推奨されている標準的な設定です。

プロンプトへの忠実さをある程度保ちながら、Clipskipの値「1」で起こりがちな細部の過剰な描き込みや画像の破綻を適度に抑制します。

これにより、イラストとしてのまとまりが良くなり、安定した品質の画像を生成しやすくなります。

初心者の方が最初に試す設定として最適であり、ここを基準に自分の好みに合わせて値を調整していくのがオススメです。

Clipskipの値「3~4」:プロンプトの解釈に少し自由度が生まれる

clipskip[3]

clipskip[4]

Clipskipの値を3や4に設定すると、プロンプトの細かい指示から少し離れ、AIによる解釈の自由度が増します。

これにより、細部の描き込みが簡略化され、全体的に柔らかく、よりアニメやイラストらしい表現が生まれやすくなります。

値が1や2ではイラストが硬い印象になってしまう場合や、もう少しアーティスティックな雰囲気を加えたいときに試す価値のある設定です。

Clipskipの値「5以上」:指示から離れ、独創的なイラストに変化する

clipskip[5]

clipskip[6]

clipskip[7]

clipskip[8]

clipskip[9]

clipskip[10]

clipskip[11]

clipskip[12]

Clip skipの値を「5」以上に設定すると、プロンプトの解釈はかなり大まかになり、元の指示から大きく逸脱した独創的な画像が生成されることが多くなります。

細部の描写はさらに抽象化され、最後の方は絵として出力されなくなってしまいます。

一般的なイラスト生成においては、意図から外れすぎるため、積極的に使用されることは少ない設定値です。

【SDXLモデル】Clip skipの値による生成画像の比較【1~12まで検証】

SDXL モデルでは、Clip skipの値をコントロールしても大きな差が生まれません。

Clipskipの値「1~2」で差分を確認して採用しましょう。

Clipskipの値「1~2」:ベストな選択

clipskip[1]

clipskip[2]

SDXLモデルでClipskipの値を設定する場合は、「1~2」を基本にしましょう。

細部にアレンジを取り入れたい場合は、「3~4」を試しに生成してみるのも良いでしょう。

Clipskipの値「5以上」:細部が変化するが大きな変化はない

clipskip[5]

clipskip[6]

clipskip[7]

clipskip[8]

clipskip[9]

clipskip[10]

clipskip[11]

clipskip[12]

Clipskipの値を「5」以上に設定しても特徴は大きく変わりません。

SDXLは、元々clip skip 2で学習されたモデルなので、Auto1111はclip skipの利用を推奨していません。

Clip skipで画像の崩れを抑えるための実践テクニック

Clipskipの基本的な役割を理解した上で、さらに一歩進んで画像の崩れを効果的に抑え、理想の画風に近づけるための実践的なテクニックが存在します。

単におすすめ値を設定するだけでなく、使用するモデルの特性を理解したり、微調整を加えたりすることが重要です。

ここでは、より高品質な画像生成を目指すために役立つ、具体的な二つのアプローチを紹介します。

使用するモデル(Checkpoint)の推奨値を確認する

Clipskipの最適値は、使用するモデル(Checkpoint)によって異なる場合があります。

モデルの制作者は、そのモデルの特性を最大限に活かすための推奨設定値を、配布ページ(CivitaiやHuggingFaceなど)の説明文に記載していることがよくあります。

例えば、アニメ系のイラストに特化したモデルではClipskip「2」が推奨されていることが多いですが、リアル系のモデルでは「1」が推奨されていることもあります。

まずはモデルの配布ページを確認し、推奨値が指定されていればそれに従うのが基本です。

制作者の意図した通りの画風を再現し、画像の崩れを未然に防ぐための最も確実な方法です。

理想の画風が出ないときは値を1つずつ変更してみる

モデルの推奨値を使用しても、生成される画像が自分のイメージと合わない場合があります。

例えば、「もう少しイラストを柔らかい雰囲気にしたい」と感じるなら、現在の設定値から1つだけ上げてみる(例:2→3)のが有効です。

逆に、「プロンプトの指示がうまく反映されない」と感じるなら、値を1つ下げてみましょう(例:2→1)。

このとき、Seed値を固定したままClipskipの値だけを変更すると、変化が比較しやすくなります。

値を一気に大きく変えると画風が激変してしまうため、1段階ずつ慎重に調整し、生成結果を比較しながら理想の仕上がりに近づけていく地道な作業がクオリティ向上に繋がります。

Stable DiffusionのClip skipは、理想の画像への近道テクニック

Clip skipはStable Diffusionにおいてプロンプトの解釈の深さを調整し生成される画像の画風やクオリティをコントロールするための重要な機能です。

一般的にプロンプトへの忠実さとイラストとしての完成度のバランスが取れている値「2」が推奨されます。

プロンプト設計やClip skip調整の試行錯誤を効率よく回すためには、安定したGPU環境が欠かせません。

ローカル環境でのセットアップはドライバやVRAM制約、発熱・騒音、電気代などのハードルがあり、モデルごとの最適値検証をスピーディに行うにはどうしても限界が出がちです。

これらの問題を一挙に解決するのがクラウドGPUです。

クラウドGPUがもたらす3つの革新

- 無限のストレージ容量 – もうディスク容量を気にする必要はありません

- チーム全体での環境統一 – 「私の環境では動くのに…」という問題から解放

- 高速な学習・推論 – 最新のGPUで開発サイクルを大幅に短縮

今回消化したStable Diffusionの環境構築もわかりやすく導入手順を紹介しています。

更にGit連携の設定から、効率的なワークフローの構築まで、すぐに実践できる内容も満載です。

GPUSOROBANは、高性能なGPU「NVIDIA A4000 16GB」を業界最安値の1時間50円で使用することができます。

さらに、クラウドGPUを利用しない時は停止にしておくことで、停止中の料金はかかりません。

クラウドGPUを使えばいつでもStable Diffusionの性能をフルに引き出すことができるので、理想の環境に近づけることができます。

\快適に生成AI!1時間50円~/