LTX-2.3は、Lightricks社が作った「LTX」シリーズの最新バージョンです。

この記事では、「LTX-2.3」の概要から、ComfyUIを用いてLTX-2.3を導入する手順を解説します。

LTX-2.3とは?

LTX-2.3とは、テキストや画像、音声から高品質な動画を生成できる最新のオープンソースAIモデルです。

特に、入力した音声に合わせて画像の人物が話しているかのような自然な口パク動画(リップシンク)を生成できる点が高く評価されています。

LTX-2.3のツール自体は、誰でも無料で利用でき、自由にカスタマイズしながら動画制作を行えるのが大きな特徴です。

前モデルLTX-2から進化したポイント

- モデル構造とパラメータの増加

-

- パラメータ数が約10〜14B程度から約22Bへとほぼ倍増しており、より長いコンテキストと複雑なプロンプトを扱えるようになりました。

- 動画の内容の制御であるシーンの構図・カメラの動き・小物配置など、空間・時間的に複雑な指示をより正確に再現できるようになっています。

- 画質・ディテールと動きの改善

-

- 新しいVAEを採用し、エッジがシャープでグラデーションがクリーンになり、テクスチャのドリフトが大幅に低減されています。

- 小さなオブジェクトや反射・スペキュラーがにじみにくくなり、動きもより自然で不自然なざらつきが減っています。

- 音声付き

-

- オーディオレイヤーが再構成され、クリックやドローン、ボイスオーバーなどに合わせたカメラ・モーションの同期が安定化しています。

- ビートに合わせた露出ダッキングや、歯擦音あたりのノイズ・フレームブレが減少し、プロっぽい音声付き動画生成がしやすくなっています。

LTX-2.3 ComfyUIでの始め方・使い方

ここでは、「ComfyUI」を使ったローカル環境でのLTX-2.3の始め方から使い方まで紹介します。

ComfyUIの導入方法はこちらの記事で詳しく解説しています。

LTX-2.3は、多くのGPUパワーが必要になりますので、余裕をもって準備をしておきましょう。

導入前に「ComfyUI」を起動して最新版に更新しておきましょう。

更新が完了したらデータのインストールに進みます。

次に、動画を生成するためのモデルデータを入手します。

動画生成に必要なモデルデータは下記の6つです。

- 動画のモデルデータ

- アップスケーラー

- テキストエンコーダー

- LoRA

ワークフローを読み込むとリストが表示されますので、順番にダウンロードを進めます。

コマンドで一つにまとめたい方はこちらの内容を入力します。

#動画のモデルデータ

cd ComfyUI/models/checkpoints

wget https://huggingface.co/Lightricks/LTX-2.3-fp8/resolve/main/ltx-2.3-22b-dev-fp8.safetensors

#アップスケーラー

cd ComfyUI/models/latent_upscale_models

wget https://huggingface.co/Lightricks/LTX-2.3/resolve/main/ltx-2.3-spatial-upscaler-x2-1.1.safetensors

#テキストエンコーダー

cd ComfyUI/models/text_encoders

wget https://huggingface.co/Comfy-Org/ltx-2/resolve/main/split_files/text_encoders/gemma_3_12B_it_fp4_mixed.safetensors

#LoRA

cd ComfyUI/models/loras

wget https://huggingface.co/Comfy-Org/ltx-2/resolve/main/split_files/loras/gemma-3-12b-it-abliterated_lora_rank64_bf16.safetensors

wget https://huggingface.co/Lightricks/LTX-2.3/resolve/main/ltx-2.3-22b-distilled-lora-384.safetensors今回は公式で配布されている総合ワークフローを使用します。

ワークフローデータは、公式に公開されている公式ワークフローをダウンロードして使用します。

ダウンロードしたワークフローデータをComfyUIの画面にドラッグ&ドロップで読み込みます。

ノードが正常に反映されているか確認します。

LTX-2.3のtext2videoでは、シンプルなプロンプトで質の高い動画を作成できます。

プロンプトには、情景などを自然言語の形式で文章入力します。

その後「▷Queue」ボタンをクリックして生成を開始します。

LTX-2.3(ComfyUI)で生成した画像

A teenage anime boy and girl stand under blooming cherry blossoms at school, petals drifting through the air, the girl looks down shyly and then looks up, the boy smiles gently, soft spring sunlight, pastel colors, clean anime line art, romantic atmosphere, shallow depth of field, slow camera orbit, smooth character motion, emotionally expressive scene

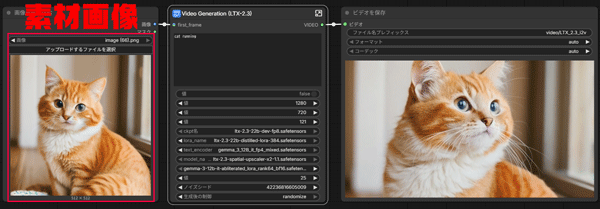

LTX-2.3のimage2videoは、最初のフレームを素材画像として動画を生成します。

image2videoのワークフローはtext2videoのすぐ上ににあります。

左下のローダーに素材の画像を読み込みます。

プロンプトには、画像の内容をベースに動きを入力します。

素材画像

スポンサーリンク

LTX-2.3の料金プランと商用利用は?

LTX-2.3の料金プランと商用利用について解説します。

LTX-2.3は「Apache 2.0」というライセンス形態で公開されており、その条件内では無料でローカル利用することができます

一方で、コンピューターリソースがない場合はAPIを利用してLTX-2.3を使います。

APIの料金表は以下の通りです。

LTX‑2.3 の API 利用料金は、「秒単位の従量課金」で、解像度とモデル品種(Fast / Pro)によって単価が決まります。主要な提供先(例:fal.ai や LTX の公式/パートナーAPI)では、おおむね次のような水準です。

LTX-2.3の商用利用は?

LTX-2.3はApache 2.0ライセンスのもとで提供されており、商用利用を含めた幅広い用途での利用が認められています。

具体的には、以下のような利用例が許可されています。

- 商用利用

- コードの改変・再配布

- 特許の使用

ただし、今後、サービス提供時にライセンスが変更される可能性もあるため、商用プロジェクトで利用する際は、最新のライセンス情報を必ず確認しましょう。

LTX-2.3のような動画生成AIにはクラウドGPUがおすすめ

LTX-2.3で高画質の動画を生成するには、高スペックなパソコンが必要です。

ただし、LTX-2.3を快適に利用できるような高性能なパソコンは、ほとんどが30万円以上と高額になります。

コストを抑えたい方へ:クラウドGPUの利用がおすすめ

クラウドGPUとは、インターネット上で高性能なパソコンを借りることができるサービスです。これにより、最新の高性能GPUを手軽に利用することができます。

クラウドGPUのメリット

- コスト削減:高額なGPUを購入する必要がなく、使った分だけ支払い

- 高性能:最新の高性能GPUを利用できるため、高品質な画像生成が可能

- 柔軟性:必要なときに必要なだけ使えるので便利

LTX-2.3を使いこなして最先端動画生成AIをマスターしよう!

今回は、動画生成AIの最新バージョン「LTX-2.3」の使い方について紹介しました。

無料で利用できる動画生成AIのオープンソースの中でトップクラスなので、このチャンスに高性能ツールで動画生成を極めてみましょう。