Stable Diffusionで特定のキャラクターや人物を再現するには、これまではLoRAによる追加学習が必要でした。

しかしInstantIDを使えば、たった1枚の顔画像から、異なるポーズや服装の画像を簡単に生成できます。

この記事では、ControlNetのInstantIDを使って人物画像を自在に再現する方法を、わかりやすく解説します。

ControlNetのInstantIDとは?

ControlNetのInstantIDは、人物画像をもとに、異なるポーズ・服装・背景でも同一人物を保った画像を自動生成できる機能です。

InstantIDの主な特徴

- 1枚の画像から多様なバリエーションを生成可能

-

顔立ちやパーツ配置などの特徴を保ちつつ、服装や背景、アートスタイルを変えた画像を作れます。

- 追加学習(LoRAやDreamBoothなど)が不要

-

LoRAやDreamBoothのような面倒な追加トレーニングは一切不要。すぐに使えるのが魅力です。

- Stable Diffusion XL(SDXL)専用

-

現時点では、SDXLモデルのみで利用可能です。

InstantIDの導入方法

InstantIDは、ControlNet内にインストールされているので、Stable Diffusion内にControlNetを実装すれば導入は完了します。

既にControlNetをインストールしている方は、InstantIDのモデルデータをダウンロードに進みます。

Stable DiffusionにControlNetをインストール

Stable Diffusion Web UIにControlNetをインストールする手順を紹介します。

ControlNetをインストールする

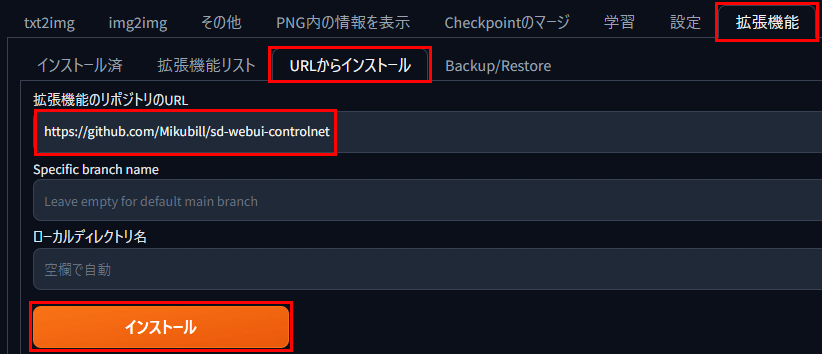

Stable Diffusion Web UIにControlNetをインストールし、拡張機能タブから「URLをインストールする」を選びます。

「拡張機能のリポジトリのURL」入力欄に次のアドレスを入力し、「インストール」ボタンをクリックします。

https://github.com/Mikubill/sd-webui-controlnet

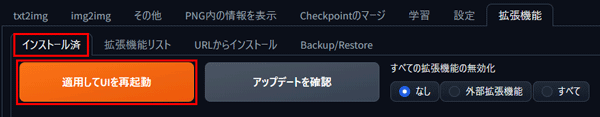

ControlNetのインストールが完了したら「インストール済」タブに移動し、「適用して再起動」ボタンでStable Diffusion Web UIを再起動します。

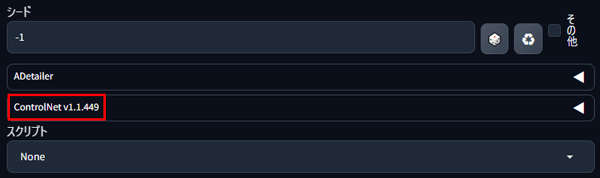

Stable Diffusion Web UIを再起動し、シード値の下にControlNetタブが表示されていればインストール完了です。

InstantIDのモデルデータをダウンロード

ControlNetのインストールが完了したら、InstantIDに使用するモデルデータをダウンロードします。

Hugging Faceから、InstantID用とIP-Adapter用の二つのモデルデータをダウンロードします。

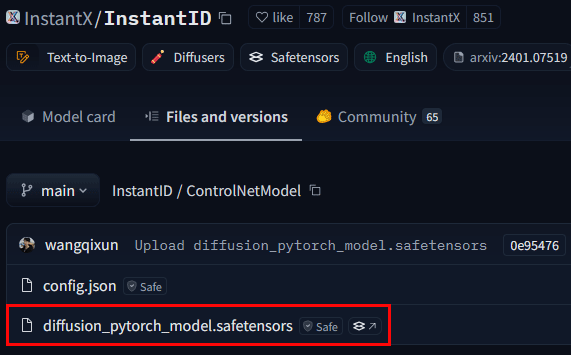

最初にInstantID用のモデルデータをダウンロードします。

・diffusion_pytorch_model.safetensors

モデル名を分かりやすくするために「control_instant_id_sdxl」に変更しておくのがおすすめです。

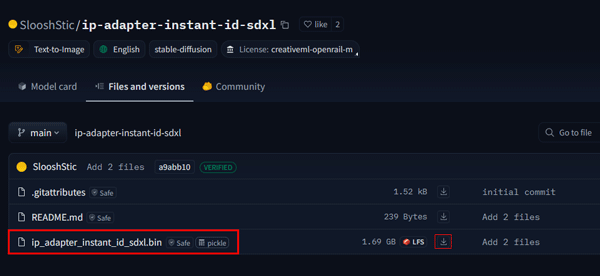

次にIP-Adapter用のInstantIDモデルをダウンロードします。

・ip_adapter_instant_id_sdxl.bin

SDXL用InstantIDモデルデータ

https://huggingface.co/InstantX/InstantID/tree/main/ControlNetModel

SDXL用IP-Adapterモデルデータ

https://huggingface.co/SlooshStic/ip-adapter-instant-id-sdxl/tree/main

ダウンロードしたデータは、Stable Diffusionの「ControlNet」フォルダに移します。

続いてInstantIDの実践例を紹介します。

ControlNet InstantIDの使い方

InstantIDの使い方をステップごとに分けて解説します。

InstantIDは、SDXLのモデルでしか生成ができないので注意しましょう。

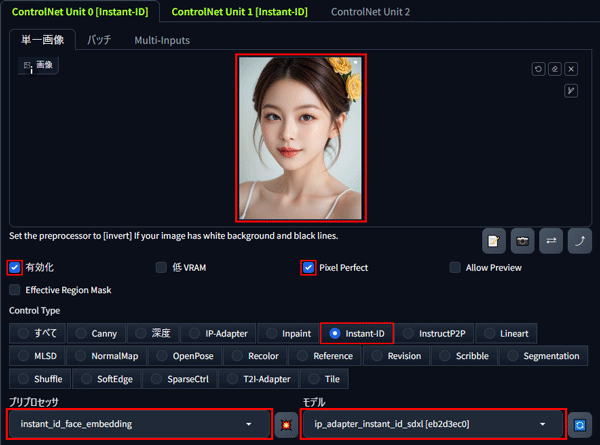

ControlNetのInstantIDを開き、ドラッグ&ドロップで素材画像を読み込み、「有効化」、「Pixel Perfect」、「InstantID」にチェックを入れます。

プリプロセッサ「instant_id_face_embedding」、モデル「ip_adapter_instant_id_sdxl」を選択します。

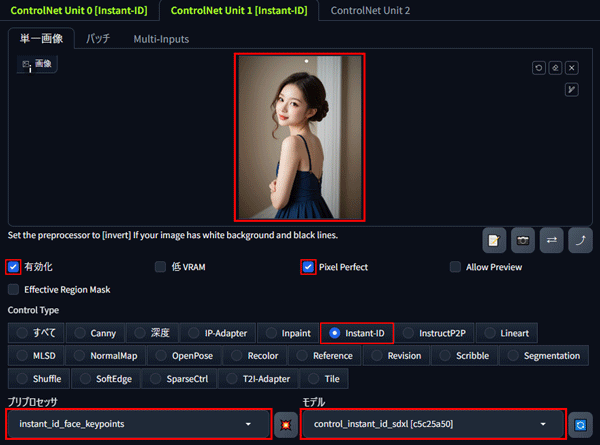

次に、ControlNet Unit 1にタブを切り替えて2つ目のモジュールを追加します。

ControlNetのInstantIDを開き、ドラッグ&ドロップで素材画像を読み込みます。

「有効化」、「Pixel Perfect」、「InstantID」にチェックを入れます。

プリプロセッサ「instant_id_face_keypoints」、モデル「control_instant_id_sdxl」を選択します。

CFGスケールを4~5に設定します。

SDXLのモデルとプロンプトを入力して生成を開始します。

SDXLモデルのパターンを用意して、背景や衣装のプロンプトなどを入力して生成を開始します。

素材人物の特徴を引き継いで、色々なパターンの画像が生成されました。

ControlNet InstantID活用事例と操作のポイント

ControlNetのInstantIDを使えば、1枚の参照画像(ID画像)から、異なるポーズや服装、スタイルの人物画像を簡単に生成できます。

本章では、具体的な活用シーンと、実際に使う際に知っておきたい操作上のポイントをご紹介します。

ControlNet InstantIDの活用事例

ControlNet InstantIDは、さまざまな分野で実用的に活用されています。

以下の事例を参考に、自身のプロジェクトや業務への応用を検討してみてください。

1.エンターテイメント業界

・映画やドラマにおける、俳優の若年期ビジュアルの再現

・ゲームキャラクターの顔パターンを生成

・キャンペーン用に、特定キャラクターの統一感ある複数イメージを作成

2.教育・公共機関・研究用途

・歴史上の人物の復元イメージの作成

・心理学分野での表情分析や実験用素材の作成

3.個人利用

・SNS用のプロフィール写真やアバター作成

・年齢変化シミュレーション(若返り・老化)

・家族写真の修復・復元

ControlNet InstantIDの操作のポイント

ControlNet InstantIDを活用する際の、基本的な操作ポイントを紹介します。

ここで挙げる3つのポイントを押さえておくことで、より高精度な画像生成が可能になります。

1. 素材画像(ID画像)の準備

ID画像として使用する素材は、顔が正面からはっきり写っている高解像度のものが理想です。

画質が高いほど、生成される人物画像の再現性や自然さが向上します。

2. プロンプト

画像に反映させたいスタイル・ポーズ・背景・表情などは、プロンプトで具体的に指示しましょう。

- 「笑顔で青空の下に立っている」

- 「アニメ風のイラスト」

- 「横顔の構図」

プロンプトの工夫次第で、生成される画像の方向性や雰囲気を自由にコントロールできます。

3. パラメータの調整

画像の仕上がりに大きく影響するのが、以下の2つのパラメータです。

- Weight(重み):ID画像の特徴をどれだけ強く反映させるか

- Guidance scale:プロンプトの指示をどれだけ強く反映させるか

ID画像を忠実に再現したい場合はWeightを高めに、自由なスタイルや背景を優先したい場合はWeightを下げて調整します。

必要に応じて、Guidance scaleも微調整しながら、生成結果を見て最適なバランスを探りましょう。

Stable DiffusionでControlNetのInstantIDを使いこなそう

Stable DiffusionでControlNetのInstantIDを使いこなすには、高いスペックのPCと数多くの生成回数が必要です。

効率的に大量のアイデア画像を生成するには、16GB以上のVRAMが搭載されたパソコンの利用がおすすめです。

しかし、高性能なパソコンの多くが30万円以上と高額になります。

そのような時は、PICSOROBANがおすすめです。

コストを抑えたい方へ:今のパソコンのまま使える「PICSOROBAN」

ピクソロのメリット

- すぐ使える:高額PC不要で、ブラウザからすぐに利用可能。必要な分だけポイントを購入できます。

- リーズナブル:30分約60円で利用可能。さらに今なら約2時間分が無料。

- 無制限作成:時間内であれば、何枚でも画像生成可能。短時間で多くの作品を生成できます。

ブラウザで簡単!ピクソロ!

PICSOROBANは、インストールの必要なくブラウザで簡単にStable Diffusionを利用できます。

さらに、今ならリリースキャンペーンとして無料会員登録するだけで、2,000ポイント(約2時間分)貰えます!

詳しい使い方は下記の記事で紹介しています。

\今なら約2時間無料で使える!/

Stable Diffusionが快適に使えるおすすめのパソコンやグラボに関しては下記の記事で紹介しています。