FramePack-Studioは、動画生成AI「FramePack」から派生した拡張プロジェクトです。

FramePack-Studioには、LoRA機能やF1生成など、さまざまな機能が搭載されています。

この記事では、初心者にも分かりやすく、 FramePack-Studioの主な機能、導入方法、使い方を解説します。

FramePack-Studio(フレームパックスタジオ)とは?

FramePack-Studioは、動画生成AI「FramePack」の使いやすさを改善した拡張機能です。

FramePackから強化された機能を中心に紹介していきます。

| 機能カテゴリ | FramePack(従来版) | FramePack-Studio(拡張版) |

|---|---|---|

| 基本機能 | 画像1枚+テキストから高品質な長尺動画を生成 | FramePackの機能を拡張し、より高度な動画生成・編集が可能 |

| LoRA対応 | 一般的なLoRAサポート | LoRAサポート強化、プロンプトと生成結果の整合性向上、クリエイター向けの表現力強化 |

| UI/UX | スクリプトやコマンドライン中心 | メタデータ保存などワークフロー効率化機能が追加 |

| プロンプト制御 | 単一プロンプトでの生成 | タイムスタンプ付きプロンプトで、時間ごとに内容を細かく制御可能 |

| シーン編集 | シーン変化の細かな制御は難しい | シーンごとにプロンプト変更可能。 ストーリー性ある動画も簡単に作成 |

| ジョブ機能 | なし | キューシステムの搭載、複数生成 |

基本機能

FramePackは、「次のフレームを予測する技術」を使った動画生成AIです。

1枚の画像+テキスト、またはテキストだけで動画を生成できます。

特に注目すべきは、文脈情報の圧縮アルゴリズム。

前のフレームの内容を解析し、次のフレームを予測・生成する仕組みによって、長い動画を作る場合でも計算負荷を一定に抑えたまま滑らかに生成が可能です。

そのため、長時間の動画でも、スムーズに生成ができるのが大きな強みです。

LoRAサポート

FramePack-Studioでは、LoRAサポートが強化されています。

メタデータの保存機能によって、生成パターンを簡単に保存することができます。

プロンプトと生成結果の整合性向上など、クリエイター向けの表現力が向上しました。

UI/UX

FramePack-Studioは、オリジナルのFramePackと比べ、より直感的で使いやすいインターフェースに改良されています。

メタデータ保存などワークフロー効率化機能が追加されていて、操作の複雑性が緩和されました。

また、エラー時に分かりやすいメッセージが表示され、復旧が簡単になったほか、動画生成の進行状況がより詳しく見えるようになりました。

プロンプト制御

FramePack-Studioでは、ユーザーが入力したプロンプト(指示や説明)と実際に作られる動画の一致度が大きく向上しました。

HunyuanVideoモデルのプロンプトを理解する仕組みを改良し、タイムスタンプ付きのプロンプト(時間ごとの指示)を処理できるようになっています。

以前のFramePackでは、プロンプト通りに動画が作られないこともありましたが、今では指定した内容がより正確に反映されるように改善されています。

シーン変化・編集

FramePack-Studioでは、タイムスタンプ付きプロンプトを用いて、動画の任意の時点ごとに異なる指示(プロンプト)を設定できます。

プロンプトブレンディングは、これら時間ごとのプロンプト間を自動的に滑らかにつなぐ仕組みです。

たとえば「5秒でカメラをのぞき込む」→「10秒でポーズをとる」といった指示を与えると、AIが両者の間のフレームを自然に補間し、自然な動画遷移を実現します。

ブレンディングは、プロンプトの切り替え点ごとに「ブレンド時間」を設定でき、ごく自然にストーリー性や連続性のある動画を直感的に作成できます。

ジョブ機能

FramePack-Studioでは、動画を効率的に作るための「順番待ちシステム(キューシステム)」が使えるようになりました。

以前のFramePackでは、1つの動画しか処理できなかったため、作業が終わるまで次のプロジェクトに進めませんでしたが、この仕組みのおかげで、生成中に次の動画の設定を済ませておくことができます。

複数の動画プロジェクトを同時進行で進められるので、作業効率が大きく向上しました。

FramePackの導入方法と概要は、こちらの記事で詳しく紹介しています。

Stable Diffusionの使い方は、機能別に下記の記事にまとめているのでぜひご覧ください

FramePack-Studioの始め方と使い方

ここでは、 FramePack-Studioの始め方と使い方について、クラウド(ローカル)Linux環境での始め方と使い方をご紹介します。

今回は、以下のような動画を作成する手順を解説します。

FramePack-Studioで生成した動画

クラウド(ローカル)Linux環境での始め方と使い方

ここでは、「GPUSOROBAN」クラウド(ローカル)Linux環境での「FramePack-Studio」のインストール方法を紹介します。

FramePack-Studioは、新規のプロジェクトとしてインストールする必要があります。

FramePack-Studioは、多くのGPUパワーが必要になりますので、余裕をもって準備をしておきましょう。

最初にFramePack-Studio専用の環境を設定します。

ここでは、conda環境を利用して整えます。

下記のコマンドを入力して環境を新規で構築します。

conda create -n fpstudio python=3.10

conda activate fpstudio

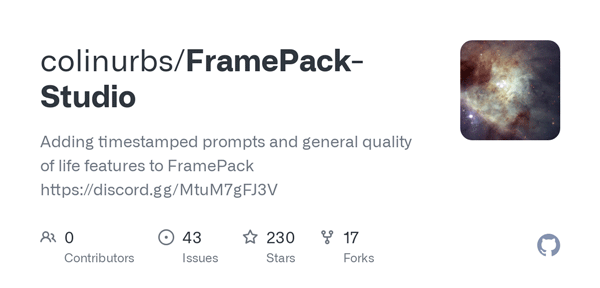

pip3 install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118次に、GitHubの公式ページにアクセスして FramePack-Studioのプロジェクトデータをダウンロードします。

続いて、依存関係を取り除きます。

git clone https://github.com/colinurbs/FramePack-Studio.git

cd FramePack-Studio

pip install -r requirements.txtFramePack-Studioを初回起動するとモデルデータのダウンロードが始まります。

cd FramePack-Studio

python studio.py数分から数十分かかりますので、その間にLoRAを入手しておきましょう。

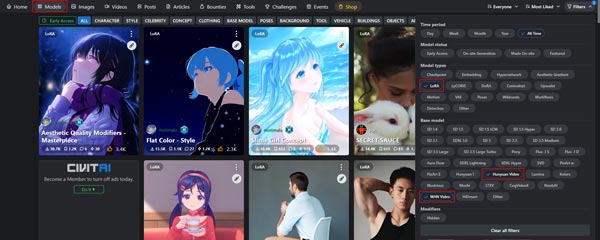

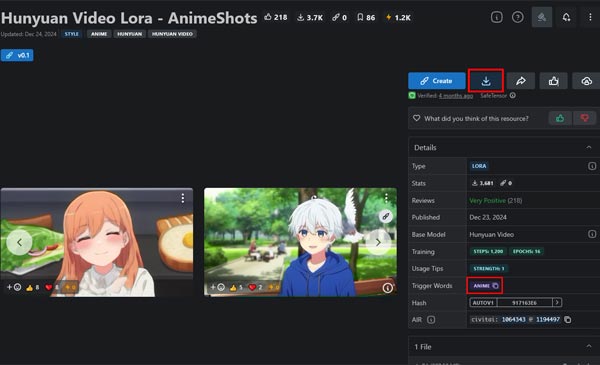

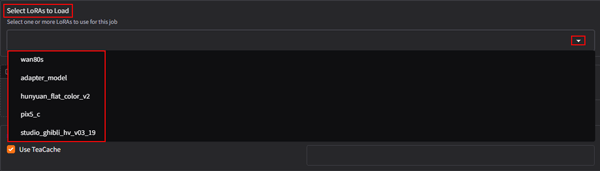

Civitaiにアクセスして動画用のLoRAモデルを検索します。

フィルターに「LoRA」「HunyuanVideo」「WAN Video」をチェックして検索を開始します。

気になったLoRAは、ページからダウンロードして手動で「📁FramePack-Studio」>「📁loras」に格納します。

記載されているトリガーワードはメモしておきましょう。

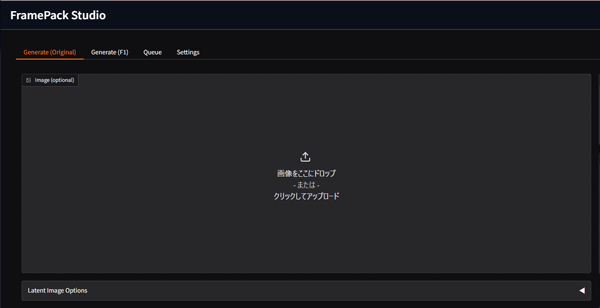

「FramePack-Studio」を立ち上げます。

新たなタブに「Generate (F1)」「Queue」「Settings」が追加されています。

本家の「FramePack」よりもスッキリしたUIになっています。

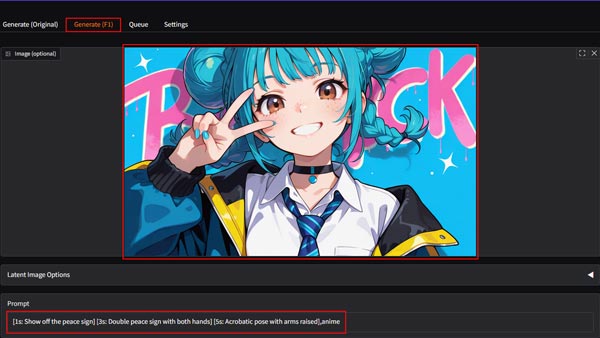

Generate (F1)とは、従来のFramePackの動画生成方法である「入力した画像から逆方向に生成していく仕組み」の逆で「順方向で生成処理をしていく」仕組みです。

この手法により、動画に物理法則と時間の流れに無理のない動きが生成結果に反映されやすくなります。

今回はF1生成にLoRAを加えて、タイムスタンプ付きプロンプトを入力し生成を実践してみます。

次に「Select LoRAs to Load」のプルダウンを開いて、LoRAを選択します。

LoRAを生成に含めて、対応するトリガーワードをプロンプトに入力します。

プロンプトの入力が完了したら、「Add to Queue」をクリックして生成を開始します。

[1s: Show off the peace sign] [3s: Double peace sign with both hands] [5s: Acrobatic pose with arms raised],anime

- タイムスタンプ付きプロンプトの内容

-

1秒~: ピースサイン

3秒~: 両手でダブルピースサイン

5秒~: アクロバティックなポーズで締めくくる

スポンサーリンク

FramePack-Studioの料金プランと商用利用は?

FramePack-Studioの料金プランと商用利用について解説します。

FramePack-Studioの公式プロジェクトはApache 2.0ライセンスのもとで提供されており、自由にコードを利用できます。

FramePack-Studioの商用利用は?

FramePack-StudioはApache 2.0ライセンスのもとで提供されており、商用利用を含めた幅広い用途での利用が認められています。

具体的には、以下のような利用例が許可されています。

- 商用利用

- コードの改変・再配布

- 特許の使用

ただし、今後、サービス提供時にライセンスが変更される可能性もあるため、商用プロジェクトで利用する際は、最新のライセンス情報を必ず確認しましょう。

FramePack-Studioのような動画生成AIにはクラウドGPUがおすすめ

FramePack-Studioを利用して長い時間の動画を制作するには、高スペックなパソコンが必要です。

ただし、 FramePack-Studioを快適に利用できるような高性能なパソコンは、ほとんどが30万円以上と高額になります。

コストを抑えたい方へ:クラウドGPUの利用がおすすめ

クラウドGPUとは、インターネット上で高性能なパソコンを借りることができるサービスです。これにより、最新の高性能GPUを手軽に利用することができます。

クラウドGPUのメリット

- コスト削減:高額なGPUを購入する必要がなく、使った分だけ支払い

- 高性能:最新の高性能GPUを利用できるため、高品質な画像生成が可能

- 柔軟性:必要なときに必要なだけ使えるので便利

FramePack-Studioを使いこなして最新性能の動画生成をマスターしよう!

今回は、FramePackの進化ツール「FramePack-Studio」の使い方について紹介しました。

FramePack-Studioは、タイムスタンプ付きプロンプトやキューシステムなどを備えた、AI動画生成のための画期的な拡張ツールです。

このチャンスに最先端AI動画生成を極めてみましょう。