この記事では、Hugging Faceアカウントの作り方やコマンドラインからのログイン方法を紹介しています。

Hugging Faceを使うことで、生成AIに必要なモデルやデータセット、Transformersライブラリを簡単に利用できるようになります。

Hugging Faceとは

Hugging Faceは生成AIの分野で人気のプラットフォームです。

Hugging Faceでは、次のようなことができます。

- AIモデルの利用

- データセットの利用

- Transformerライブラリの利用

Hugging Faceのアカウント作成

Hugging Faceのアカウントを作成していきます。

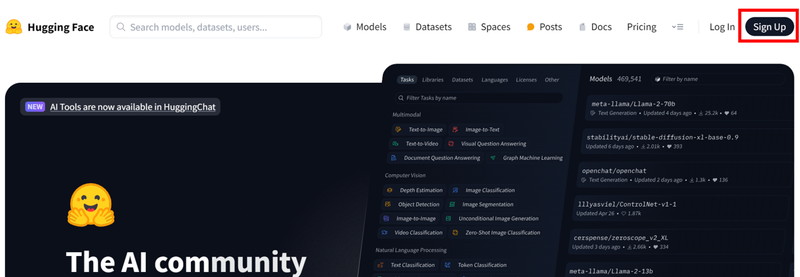

Hugging Faceの公式ページにアクセスし、「Sign Up」をクリックします。

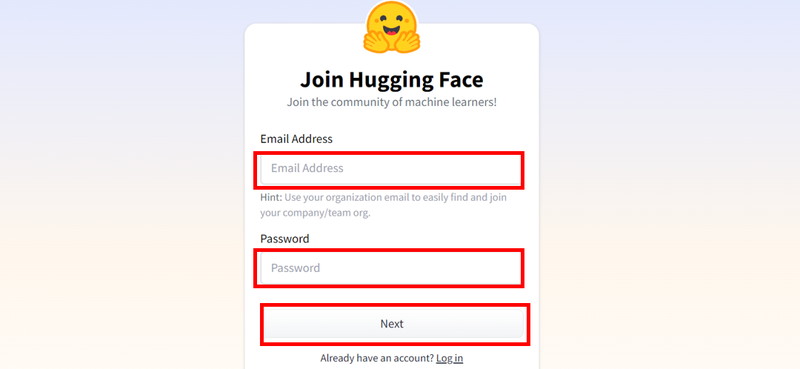

登録するメールアドレスとパスワードを入力して、「NEXT」をクリックします。

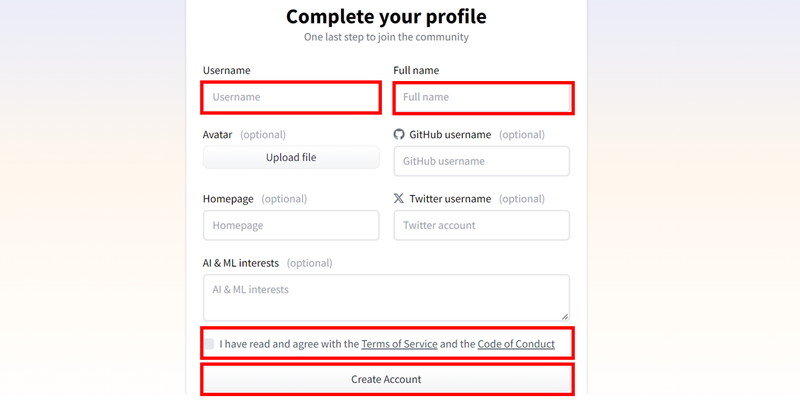

「Username(ユーザー名)」と「Full name(氏名)」を入力します。

「Terms of Service(利用規約)、Code of Conduct(行動規範)」に同意した上で、「Create Account」をクリックします。

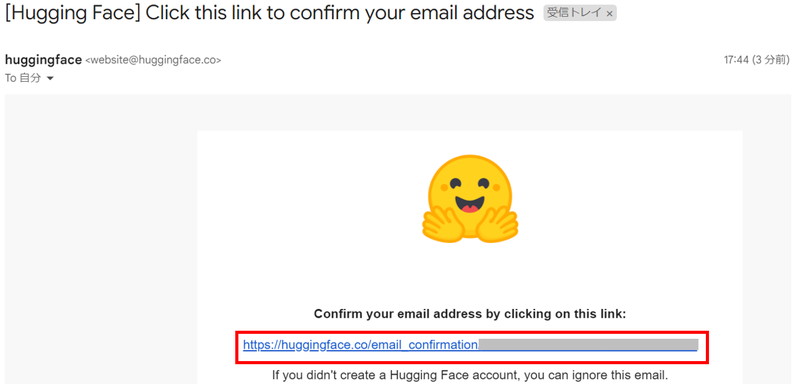

登録したメールアドレスに認証メールが送られますので、URLをクリックして認証します。

Hugging Faceのアクセストークンの作成

コマンドラインからHugging Faceのモデルをダウンロードする際に、アクセストークンが必要になります。

ここではアクセストークンの作成方法を解説します。

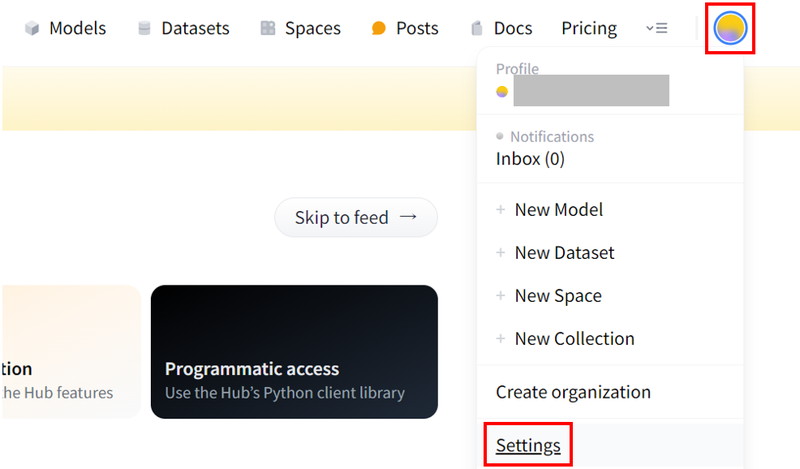

Hugging Faceの公式サイトにログインし、右上の「丸いアイコン」をクリックし、メニューから「Settings」を選択します。

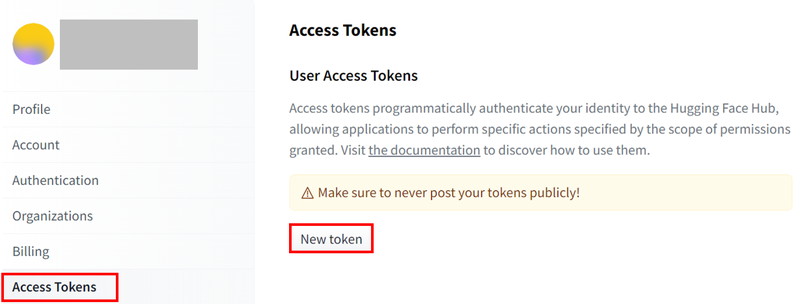

サイドバーから「Access Tokens」を開き、「New token」ボタンをクリックします。

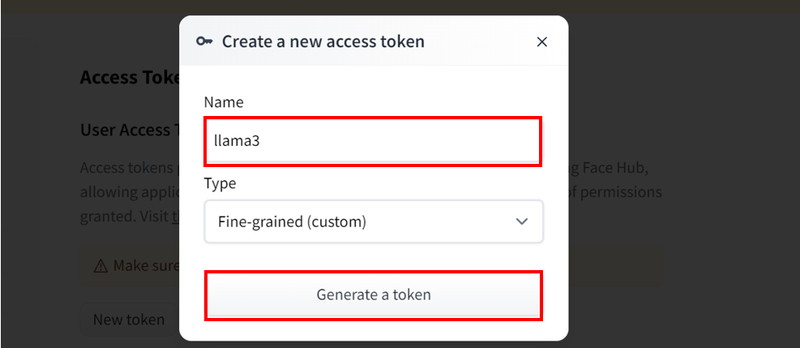

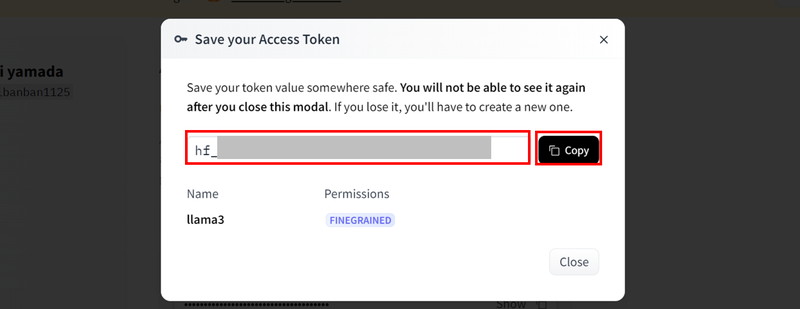

「Name」にアクセストークンの任意の名称を入力し、「Generate a token」を押すと、アクセストークンが作られます。

「Copy」ボタンを押すと、アクセストークンをコピーできます。

コマンドラインからHugging Faceにログインする

モデルをダウンロードする際に、コマンドラインからHugging Faceにログインする必要があります。

ここではコマンドラインでのログイン方法を紹介します。

お使いの環境で次のコマンドを実行して、HuggingFace HubのCLIをインストールします。

pip install -U "huggingface_hub[cli]"Pythonを起動します。

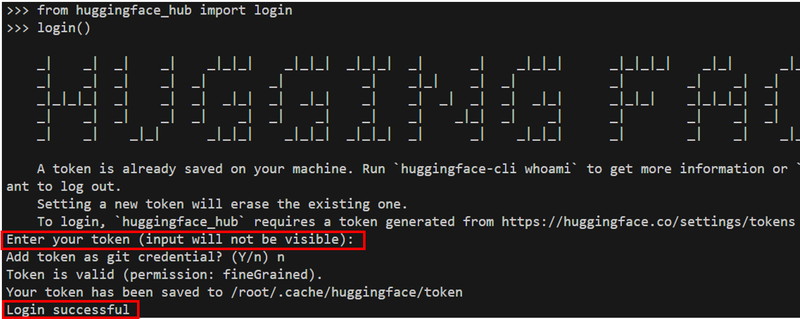

pythonHuggingFace Hubからlogin関数をインポートします。

from huggingface_hub import loginlogin関数を実行し、Hugging Faceへアクセスします。

login()

生成AI・LLMのコストでお困りなら

GPUのスペック不足で生成AIの開発が思うように進まないことはありませんか?

そんなときには、高性能なGPUをリーズナブルな価格で使えるGPUクラウドサービスがおすすめです!

GPUSOROBANは、生成AI・LLM向けの高速GPUを業界最安級の料金で使用することができます。

インターネット環境さえあれば、クラウド環境のGPUサーバーをすぐに利用可能です。

大規模な設備投資の必要がなく、煩雑なサーバー管理からも解放されます。